はじめに

この記事は、ラスベガスで開催されているGoogle Cloud Next 2025のセッション聴講記事です。

セッションタイトル:

Building gen AI solutions with responsible guardrails

なぜ?責任あるAIが重要なのか?

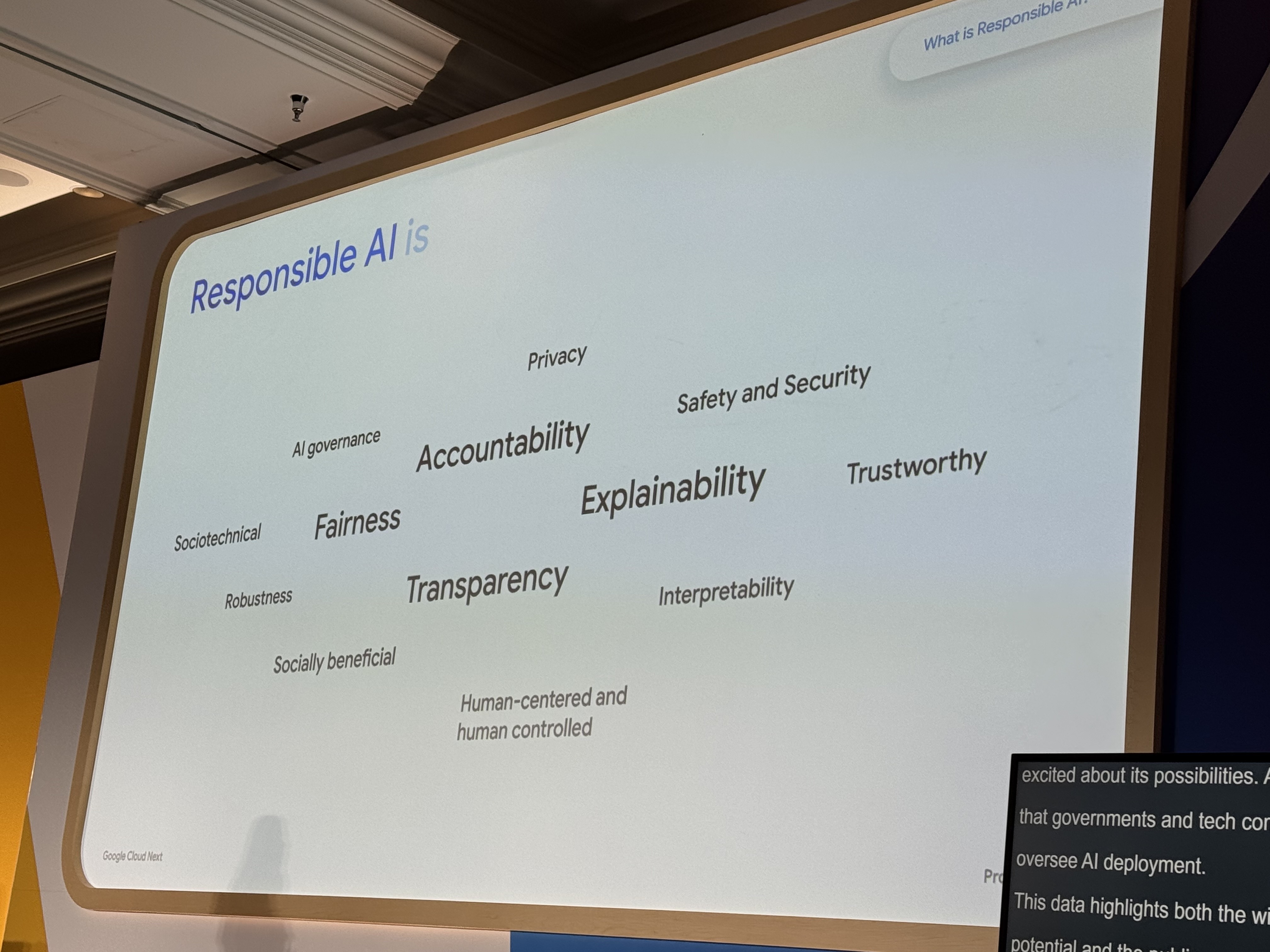

そもそも、責任あるAIとは、様々な側面から構成される概念です。

大きい観点として以下から構成されます。

- Accountability (説明責任)

- Explainability (説明可能性)

- Fairness (公平性)

- Transparency (透明性)

Google Cloudの責任あるAI開発に対するアプローチ

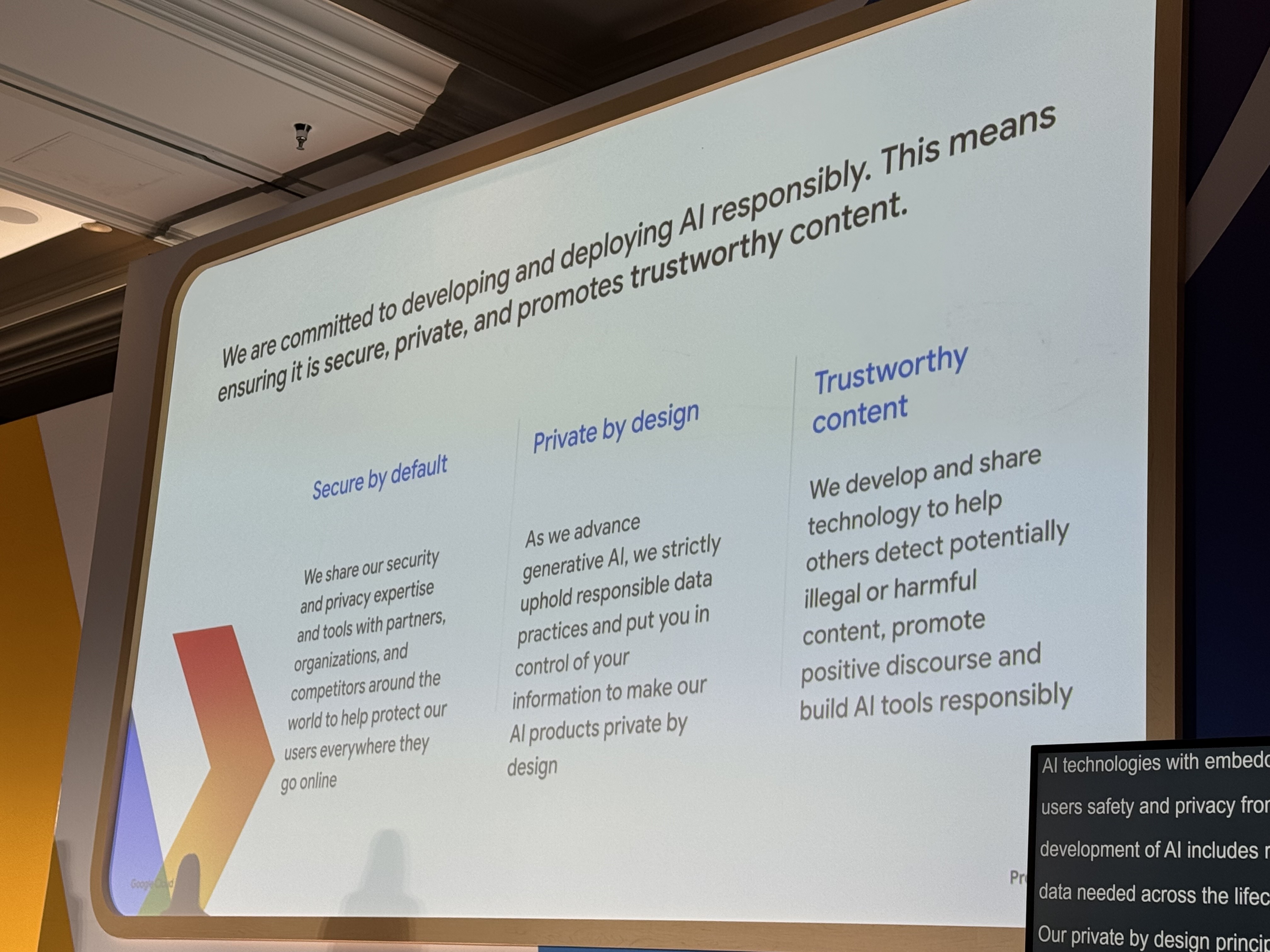

Googleは、AIのある責任AIの開発・デプロイすること、特に力をいれており、以下の3つの柱に基づいています

- Secure by default

- Private by design

- Trustworthy content

また、もちろんGoogle製品にもこの3つの柱に基づいて設計されています。

例えば、いつもお世話になっているGmailのブロック機能ですが、スパム、フィッシング、マルウェアなどの99.9%以上をブロックできているようです!

他には、SynthIDでは、AIにて生成されたコンテンツに、デジタル透かしを埋め込み、その出所を識別できるようにしているそうです!

AIが生成したコンテンツの質が高すぎて…、一見しても手作りなのか、AIなのか、見分けがつかないですし…、権限侵略したり・守ったりするために大切なことですよね。

ガードレールの必要性

もしも、ガードレールを追加しない場合のリスクはなんでしょうか…

少なくとも以下の3つが想定されます

- Jailbreaking (ジェイルブレイク)

- ユーザーが制限を回避したり、安全でない出力を強制したりしようとする試み。

- Prompt Injection (プロンプトインジェクション)

- 外部からの入力がモデルの動作を操作すること。

- lack of prompt masking (プロンプトマスキングの欠如)

- システムプロンプトなどが公開されたり、ユースケース以外の使い方をされたりすること。

ベストプラクティス

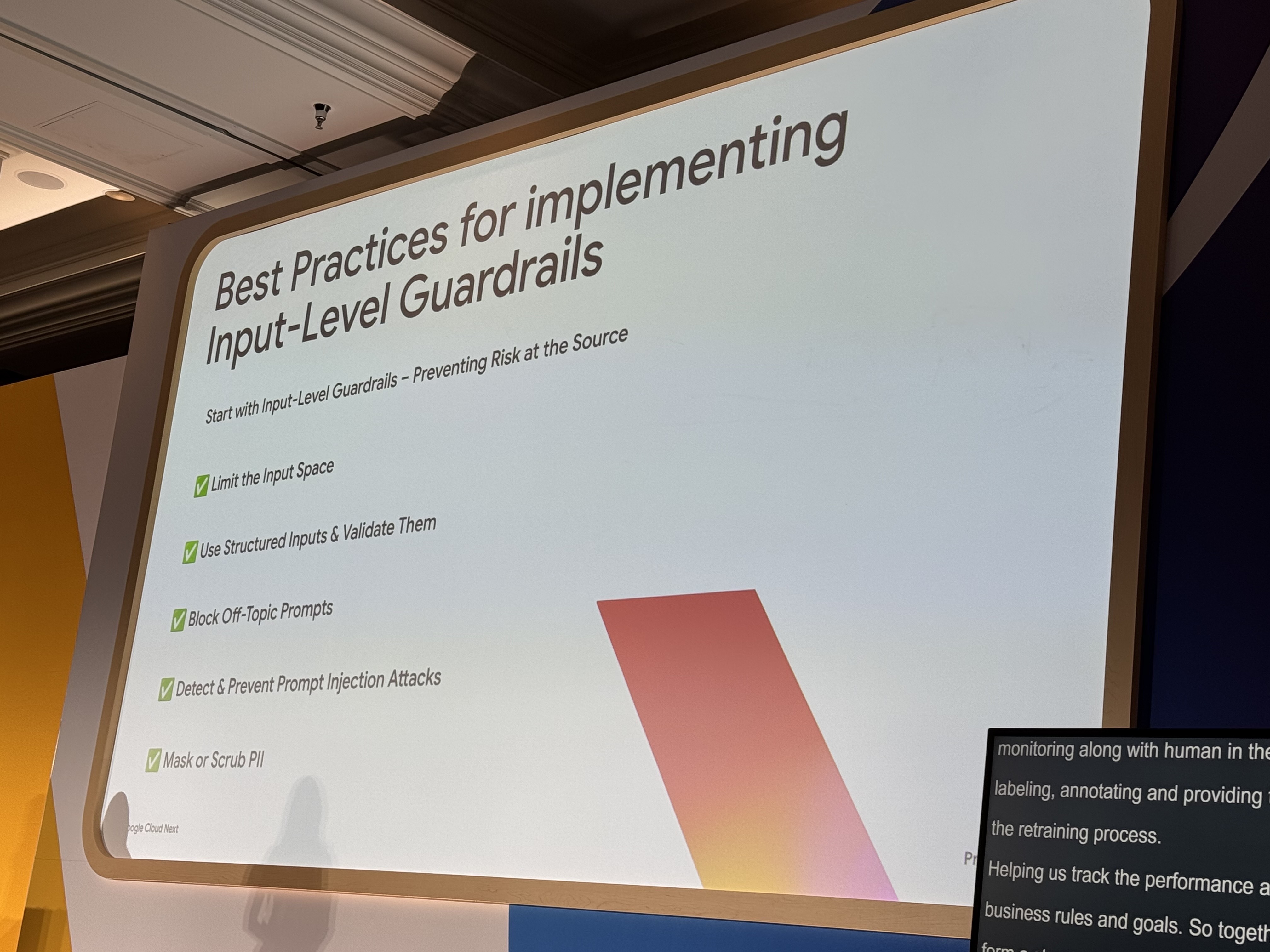

では、ガードレールはどのように設定するのか?

Priceline社による、ベストプラクティスを紹介します。

ガードレールは、インプット・アウトプットのどちらにも適用することが重要です。

インプット

ユーザのプロンプトをモデルに渡す前にチェックされます。

- Limit the Input Space

- 入力スペース(範囲)を制限

- Use Structured Inputs & Validate Them

- 構造化された入力を使用し、検証

- Block Off-Topic Prompts

- オフトピック(主題から外れた)プロンプトをブロック

- Detect & Prevent Prompt Injection Attacks

- プロンプトインジェクション攻撃を検出し、防止

- Mask or Scrub PII

- PII(個人を特定できる情報)をマスク削除

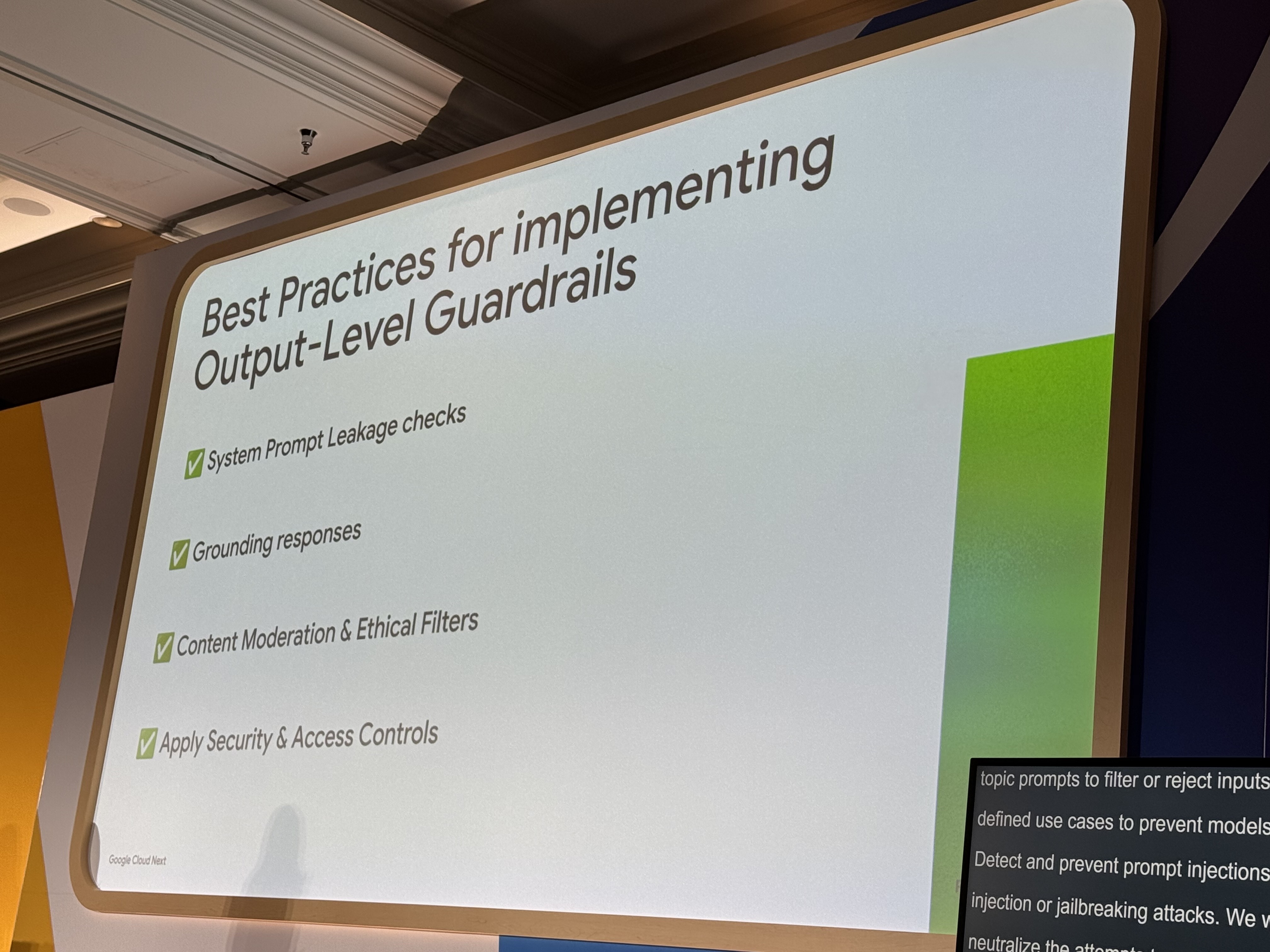

アウトプット

モデルから生成結果をユーザーに返す前にチェックされます。

- System Prompt Leakage checks

- システムプロンプトの漏洩チェック

- Grounding responses

- レスポンスがグラウンディングしているかどうか

- Content Moderation & Ethical Filters

- コンテンツモデレーションと倫理フィルタ

- Apply Security & Access Controls

- セキュリティとアクセス制御を適用

パフォーマンス最適化

また、オブザーバビリティもとても重要です。

モデルの動きの理解はもちろん、そこから改善することもできます。

- Explainability & Debugging

- 説明可能性とデバッグ

- Iterate & Improve Guardrails

- ガードレールの反復と改善

- Track Hallucinations & Grounding Failures

- ハルシネーションとグラウンディングの失敗をトレース

- Evaluate Guardrails

- ガードレール自体を評価

まとめ

今回のセッションでは、いかに責任のあるAIを実装するのが大切であるかや、

Google Cloudが責任あるAIの構築のために重要視している3つの柱や、

Priceline社がどのようにガードレールを実装して生成AIソリューションを安全かつ効果的に構築しているかについて、貴重な洞察を得ることができました!

ガードレールなどを活用して安心で安全なAIアプリや、Agentを構築していきましょう!