はじめに

生成 AI エージェント (以下、AI エージェント) は、ビジネスや個人の思考そのものを変える革命的な技術として活用されています。

しかし、インターネットというエコシステム全体を考えると、技術的な課題が取り残されているように見受けられます。

この記事では、セキュリティの専門家として AAA ( Authentication, Authorization, Accounting ) の観点から課題の明文化を行います。

この記事は考察記事です。

具体的な解決策は示されていません。 健全なエコシステムに対する課題提起です。

AAA とは

AAA とは、Authentication, Authorization, Accounting の略で、認証、認可、アカウンティングと略されます。

認証は、利用している個人を特定する技術。

認可は、SNS 利用や News サイト利用等の許可を与える技術。

アカウンティングは、使用料の適切な支払い、ログ記録、監査に関する技術です。

これらは、健全なエコシステムを支える基盤となるものです。

AI エージェントの健全な活用

AI エージェントは、Google Gemini に代表される、ユーザーに代わり自律的な調査や考察が可能な AI サービスを指します。

ユーザーはサービス上でチャットベースの指示を与えることで、その裏側では AI が自律的に問題解決を行います。

開発者向けのサービスとしては、Devin などのプログラムの課題に対して自律的な対応を行うサービスも存在しています。

この記事では、これらの自律的な AI エージェントが引き起こす問題を検討します。

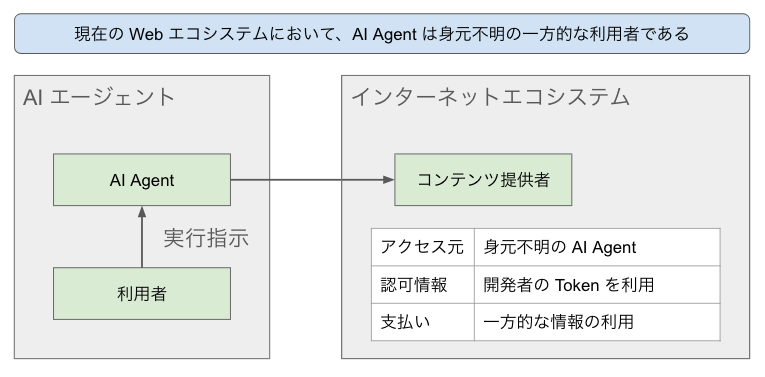

AI エージェントディストピア

AI エージェントは、現在のインターネットエコシステムでは情報の一方的な利用者でしかありません。

そのため、AI エージェントを締め出してコンテンツ提供を拒否する動きが加速しています。

これは、AI エージェントの健全な発展とは言い難い状態です。

このような問題を解決するために、必要となる検討を問題提起します。

認証 (Authentication) に関する考察

AI エージェントは、ユーザーの代理としてあらゆる調査を実施します。

この際、個人を特定するための認証が不足していると考えています。

サーバーに対する識別情報 (Identification) の開示

インターネットエコシステムでは、身元を特定可能な情報として IP アドレスが常に開示されています。

誹謗中傷などの法的問題が発生した際に、IP アドレスを基にして情報開示請求を実施可能であるという事実は、現在のインターネットエコシステムの健全性を担保する一役を買っています。

AI エージェントは、ユーザーの身元を伏せることが可能です。

匿名性の陰に隠れた自律的行動は、責任の所在(Accountability)を曖昧にし、エコシステムの信頼性を損なうリスクがあります。

この問題に対して、AI エージェントには識別情報を提示する必要性が求められていると考えます。

AI エージェントはユーザーに対する Authentication(認証) を担い、その正当性を保証します。

一方で、コンテンツ提供者に対しては、セッションを特定するための Identification(識別) 情報を提供します。

これにより、コンテンツ提供者は『誰が(個人)、どの AI エージェントを用いて』アクセスしているかを信頼性を持って把握できるようになります。

過去には、Proxy などの代理応答に対応するため、X-Forwarded-For などのヘッダが実装されました。

このような仕様が AI エージェントにも求められると考えています。

AI エージェント自体の健全性

AI エージェントは自由に作成して、自由に実行することが可能です。

しかし、コンテンツ提供者にはエージェントの身元を特定する手段が提供されていません。

かつては robots.txt などで、Web Crawler などに対して指示を与えていました。

このような形で、AI エージェント自体を信頼する仕組みが必要になると考えます。

AI エージェントは多様です。

Google Gemini のようなユーザーによる調査を主たるサービスとするものだけでなく、自律的な脆弱性診断などの攻撃を仕掛けるものも存在しています。

このような、アクセス元を信頼するための仕組みは必要不可欠です。

AI エージェントの運用組織や、運用ポリシーなどを明示して、コンテンツ提供者が適切な AI エージェントを許可する仕組みが必要になると考えます。

認可 (Authorization) に関する考察

原則として、AI エージェントの調査はユーザーの代理としての権限がありません。

Google Gemini による Google Workspace や Gmail の呼び出しなど、サービス内であれば連携は可能です。

しかし、サービスの枠を超えて権限を連携するための仕組みは存在していません。

MCP (Model Context Protocol) は、MCP サーバーとして動作させる際にサーバーに対する認証を付与する仕組みであり、利用者に対する認証や認可は提供されていません。

代理による権限の行使

AI エージェントがユーザーの調査を拡張する以上、ユーザーの代理としての権限を適切に受け取ることは重要です。

現在は、インターネットなどの公開された情報や、同一サービス内の拡張を用いた権限の使用は可能ですが、SNS アカウント内の情報を用いた拡張などはできません。

OAuth が、このような認可に対する問題を解決したように、AI エージェントが認可情報を安全に扱うための仕組みが必要不可欠であると考えます。

認可情報は、ユーザー、AI エージェント、サービスプロバイダーの 3者間の問題になります。

どのように安全に AI エージェントを信頼するか、新しいプロトコルが必要になると考えます。

ユーザーに紐づくサービスカタログの提示

AI エージェントが自律的な調査をユーザーの代理として実行すると考えた場合、ユーザーが利用できるサービスが網羅的であることが必要です。

利用している SNS やニュースサイト、プライベートなストレージなど、アクセス可能な情報源がカタログ化されていることで、AI エージェントはユーザーの意図に基づき、最適な情報源を自律的に選定・活用することが可能になります。

MCP は、AI に対して具体的なリソースや Context を提供する強力な仕組みです。

しかし、ユーザー主体のエコシステムを構築するためには、より抽象度の高いサービスレイヤーでの定義と認可が望ましいと考えます。

これにより、個別の技術仕様に依存せず、ユーザーが自身の「データ主権」を直感的に管理できる基盤が整います。

詳細な権限移譲

AI エージェントによる調査では、この調査 ( Chat session ) のみ許可したいといった限定された許可が必要だと考えます。

今の許可は、アプリケーション自体を信頼したり、時間 (e.g. 1時間) で許可するなどの許可が一般的です。

これらに対して、より細かい単位での認可プロセスが必要になると考えます。

どのような目的で権限を必要としているのか、CRUD (Create / Read / Update / Delete) の観点のほか、範囲までも含めたより精緻な制御が必要となります。

既存の認可プロトコルでは、AI エージェントのような高度な自律性と、チャットセッションごとの動的な権限管理を両立させるには限界があります。

例えば、特定の Session ID を包含したセッション限定トークンの発行など、AI エージェントの挙動を安全に制御するための新たな認可フレームワークの検討が不可欠です。

アカウンティング (Accounting) に関する考察

AI エージェントによる調査は、現在の広告による収益モデルに合致しません。

AI に調査させることにより、コンテンツ提供者は広告をエンドユーザーに対して表示できず、収益を得ることができません。

これは、健全なエコシステムが成り立っていない問題であり、AI エージェントを追い出すような検討も一部始まっています。

AI エージェントによる支払能力の提示

AI エージェントのさらなる発展のためには、情報源に対して適切な支払いプロセスが必要になると考えています。

かつて、ブラウザに広告を表示させて収益を得ていたように、AI エージェントが支払能力を提示することで、コンテンツ提供者が収益を得られる仕組みは、必須であると考えています。

AI エージェントのためコンテンツ提供

コンテンツ提供者は、現在はあくまでも利用者のために Web サイトなどを運営しています。

AI エージェントが推論に対する利用料を支払うことで、AI のためにコンテンツを利用できる仕組みが必要になると考えます。

この仕組みでは、かつての XHTML のように、AIが解釈しやすい構造化データ提供が必要であると考えています。

多様なニーズに対する期待

AI に対するコンテンツ利用は、多岐にわたります。

モデルの学習に対する教師データ、RAG などのベクトルストアに対する格納、AI エージェントによる動的な探索など、多くの利用が期待されています。

モデルや、RAG などでは、コンテンツは静的なデータとして格納されて利用されます。

このような利用においても、適切な利用料を還元することで、より柔軟な活用が可能になると考えています。

このような活用を考えると、View 単位の利用料ではなく、貢献度などの指標による支払いが必要になると考えます。

モデルは学習利用のための利用。RAG は、内部に保管されたデータの参照回数。AI エージェントではアクセス回数などが現実的な指標と考えられます。

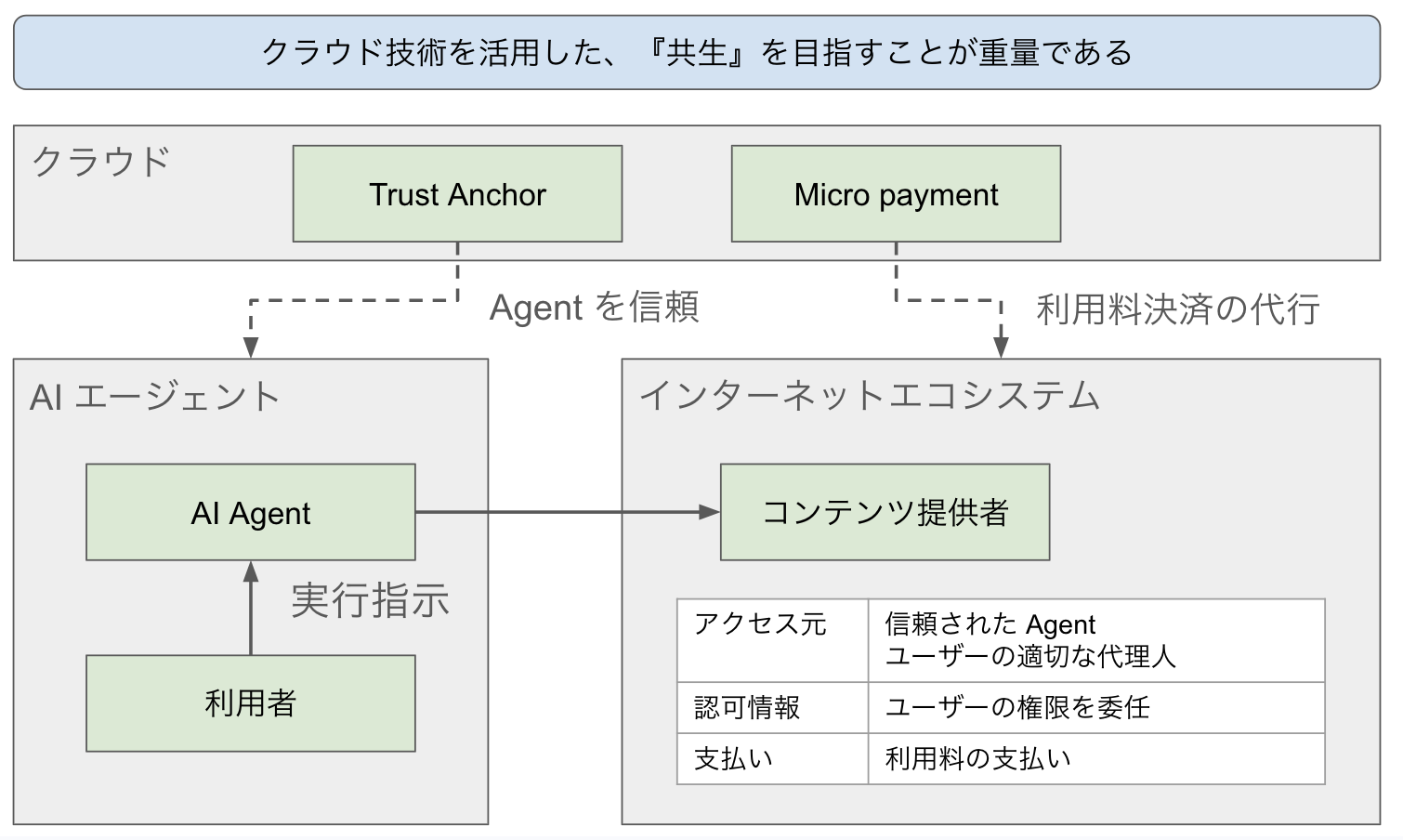

クラウドに対する期待

このような AAA を実現するためには、クラウド基盤の活用が不可欠であると考えられます。

クラウドベンダーは、大規模なインフラと、ユーザー管理基盤を有しています。

この基盤を用いて、以下のような技術が期待されています。

信頼の起点

信頼の起点 (Trust Anchor) としての能力がクラウドに求められます。

ビジネスに合わせて多くの AI エージェントが出現しています。

これらすべてをコンテンツ提供者が信頼することは不可能です。

AI エージェントの身元を明かし、信頼できる認可情報を提供することは、クラウド基盤にしか提供できない能力であると考えます。

マイクロペイメント能力

AI エージェントによる、コンテンツ提供者に対する支払いは、0.1円 / View などの非常に細かい単位になると考えます。

この単位ごとに課金を発生させるのは、支払手数料などの観点から現実的では有りません。

ユーザーからの集金、コンテンツ提供者に対する支払い含めて、大規模に実現するためには、支払い仲介者としてのクラウド能力が求められます。

AI エージェントが推論を実施する際に、ユーザーから集金して必要となったコンテンツの貢献度を正しく計算し、費用をコンテンツ提供者に分配することが期待されます。

プライバシー保護と計数管理の両立については、責任の分解によるアプローチが有効です。

クラウド基盤が仲介役となり、ユーザーの具体的な属性情報は秘匿したまま、利用実績と支払い能力のみを証明する仕組みを構築します。

これにより、プロバイダーはプライバシーを侵害することなく、正当な対価を受け取ることが可能になります。

標準プロトコルの策定

AI エージェントは、大規模な実行のためにクラウドの能力を必要としています。

これらの AAA の課題を調整しうる団体は、クラウドベンダーしかないと考えています。

オープンな仕様を策定するためのリーダーシップを取ってくれることを期待します。

ここでのクラウドベンダーの役割は、特定のプラットフォームを推奨するものではなく、大規模な ID 管理と微小決済を支えるための『計算能力(Capability)』としての議論です。

この Trust Anchor の役割を、複数のクラウドが相互運用可能な形で提供するか、あるいは分散型 ID(DID)などの技術と組み合わせるかは、今後の標準化の大きなテーマとなります。

AAA の実現した世界

これらの AAA が実現した世界では、ユーザーはより柔軟に AI エージェントを用いた探索が可能になると考えます。

セッション単位で、自身の SNS や、購読済みの News サイトの情報を用いた推論を行うことが可能になると考えます。

また、AI エージェントを利用する際に広告表示や課金処理が実施されて、その費用がコンテンツ提供者に適切に分配されることで、健全なエコシステムの継続が成り立つと考えられます。

この世界では、AI エージェントによるアクセスは情報を取っていくだけの厄介者ではなく、代理支払いを実施してくれる利用者です。

まとめ

AI エージェントは、ユーザーの代理として可能になることがどんどん増えています。

しかし、このままではコンテンツ提供者から見放され、AI エージェントの締め出しが加速することが懸念されます。

AI エージェントの健全な発展のためにも、AAA の検討は必要になると考えます。

この課題は、企業や開発者が主導して解決できるものではありません。

インターネットがこれまでそうであったように、オープンな議論と標準化の積み重ねが必要です。

本記事が、AI エージェントの利用を前提としたエコシステムの再設計について、皆様と議論を深める第一歩となれば幸いです。

![[Linux] sshでGSSAPIを使ったシングルサインオン(SSO)](https://iret.media/wp-content/themes/clp_media/img/common/home-thumbnail_360x240.png)