はじめに

今回するのは、物体検出手法であるYOLO11の既存モデルのリアルタイム物体検出の実装です。

簡単にYOLOについて紹介しますが、詳しくはこちらを見ていただけるとわかりやすいかと思います。

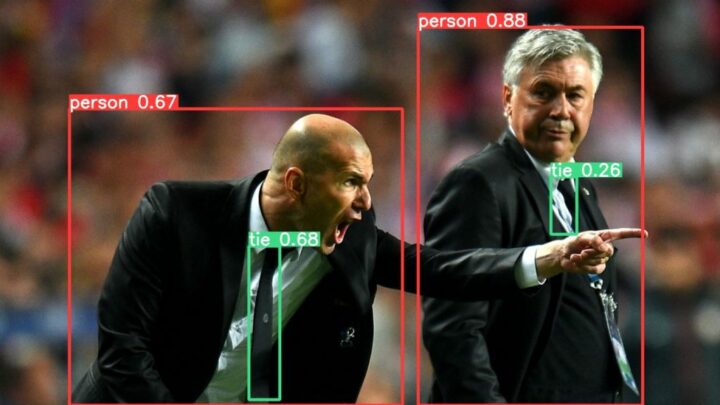

YOLO:物体検出手法の一種であり、動画像内の物体に対して物体名と信頼度の表示がリアルタイムで可能。

YOLO11:YOLOのバージョン11であり、検出精度と速度が上昇している。「物体検出」に加えて、「インスタンス分類」、「画像分類」、「姿勢推定」、「指向性物体検出」が利用可能。

既存モデル:事前に用意されている学習済みのモデルであり、犬や猫など80種類の物体を学習なしで検出可能。

->以下、物体検出の例です。 スーツや顔が検出されていないのは、既存モデルに含まれていないからです。

リアルタイム物体検出の実装

本題の実装です。実装はターミナルとVSCode(Visual Studio Code)で「リアルタイム物体検出」をやっていきます。

Pythonが入っていることが前提なので、入ってない場合はインストールしてください!

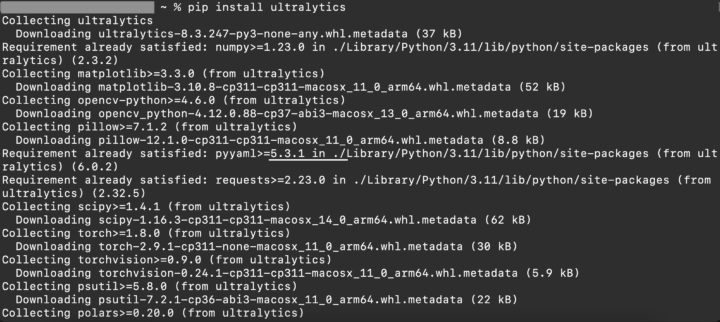

①ultralyticsのインストール

以下のコードを打ち込むことで、ultralyticsライブラリを Python 環境にインストールします。画像は見切れているので短いですが、色々インストールされてもっと長いです。

pip install ultralytics

②コードの記載

VSCodeやメモ帳を使い、ファイルを「任意の名前.py」で作ります。

その後、以下のコードを打ち込むことで先ほどインストールしたultralytics、modelを指定することでYOLO11の物体検出が利用できます。

また、Webカメラを使うので、カメラの指定やメモリを食わないよう記載します。

from ultralytics import YOLO

model = YOLO("yolo11n.pt")

results = model(source=0, show=True, stream=True)

for r in results:

pass

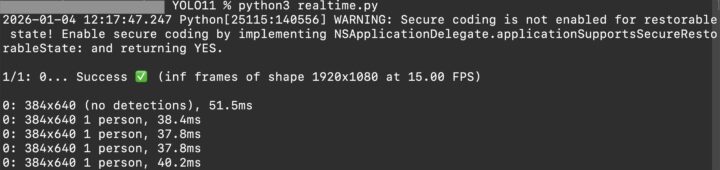

③リアルタイム物体検出の実行

cdで先ほど作成したファイルが入っているフォルダに移動してください。

以下のコードをターミナルに打ち込むことでYOLO11が起動し、リアルタイムで物体検出してくれます。

python3で動かない場合は、pythonにしたら動くかもしれません。

python3 作成したファイル名.py

YOLO11が起動したら、Webカメラに色々物体を映してみます。

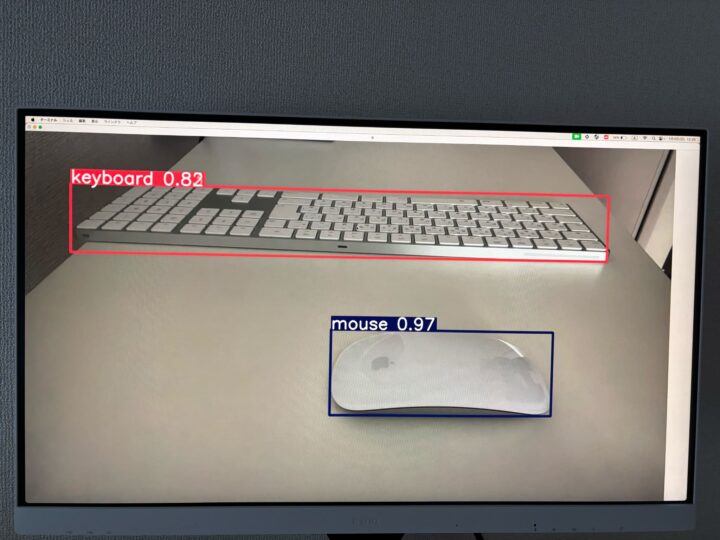

今回は既存モデルなので、こちらに記載のあるマウスとキーボードを映しました。

結果を見ると、映したキーボードやマウスが検出されています。

信頼度は、キーボードが82%、マウスが97%で、かなり確信があったことが伺えます。

以上がYOLO11での既存モデルを用いたリアルタイム物体検出です。

リアルタイム物体検出は、自動運転や、防犯などに役に立ちます。

簡単にできるので、やってみてください!

参考文献

iret.media: 【物体検出手法】YOLO11とは?,(2026/1/4)

ultralytics: COCO データセット, (2026/1/4)

Visual Studio Code,(2026/1/4)

ultralytics: Ultralytics YOLO11,(2026/1/4)

出典:

出典: