こんにちは、DX開発事業部の今立です!

今回は、AIが人間のように画面を見てマウスやキーボードを操作する技術「Computer Use」を実際に触ってみたので、その内容をご紹介します。

Computer Useってどんなもの?

そもそもComputer Useとは、AI(LLM)がデスクトップのスクリーンショットを解析して、ボタンや入力フォームを認識し、人間と同じように操作を代行してくれる技術です。APIでシステム同士を繋ぐこれまでの自動化とは違い、「画面を見て操作」してくれます。

今回は、手元のPCに専用の操作環境(コンテナ)を作り、AIの頭脳としてGoogleのAPIを繋ぎ込む構成で検証しました。

- Rancher Desktopの導入: コンテナ環境を手軽に作れるツールを使って、仮想のデスクトップ環境を準備。

- Gemini APIの連携: Googleの「Gemini API(今回はGemini 3.0)」のキーを取得して設定。

- コンテナの起動: Computer Useが動く専用の環境を立ち上げます。

今回試したデモの内容

セットアップした環境で、「京都の日帰り観光ツアーの計画」という、いくつかアプリを切り替えて使うタスクをAIにお願いしてみました。

【AIに出した指示(プロンプト)】

京都の観光マップか人気スポットを検索して、主要な3つのスポットの位置関係を把握して。

フリーボード(Freeform)を立ち上げて、新規ボードを作成して。そこにペンツールで『北・中央・南』のエリア分けをざっくり描いて。その図の上に、調べた3つのスポット名をテキストボックスで適切なエリアに配置して。

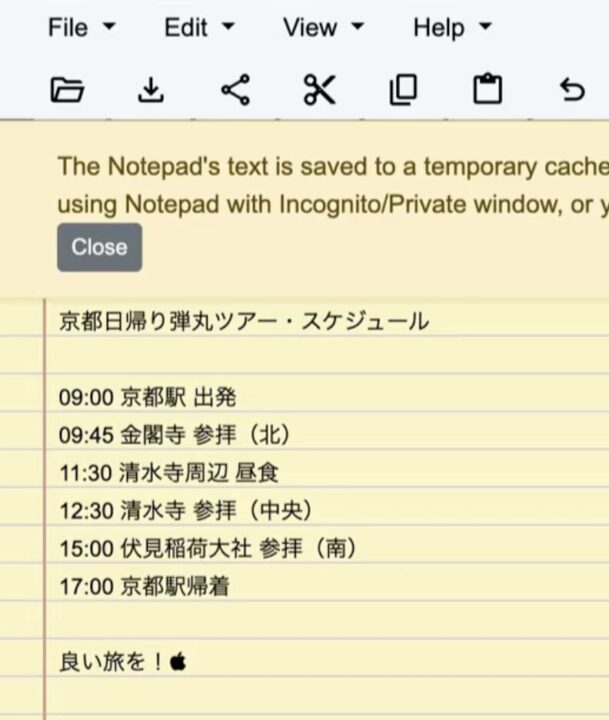

メモ(Notes)アプリを新規で開き、そこへ1分単位の分刻みの移動スケジュールを書き出して。全部終わったら、僕に向かってメモ帳の最後に『良い旅を!』と書いて。

【実際のAIの動き】

AIは普段使っているChromeとは別の青っぽいアイコンのウィンドウが立ち上がりました。

「京都 観光スポット 人気ランキング」と私自身全くキーボードを触っていないのですが検索欄に入力してくれました。

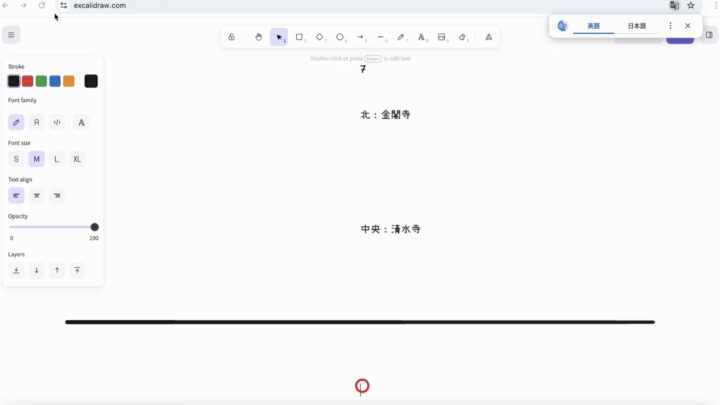

「金閣寺」「清水寺」「伏見稲荷大社」をピックアップしたあと、自ら「京都 観光マップ 北 中 南」と画像検索をして位置関係を学習し始めました。

その後、ホワイトボードツール(Excalidraw)を開いてテキストを配置し、

最後にメモ帳ツールへタイムスケジュールを書き出してくれました。しっかり林檎まで出力してくれました🍎

検証してわかったこと

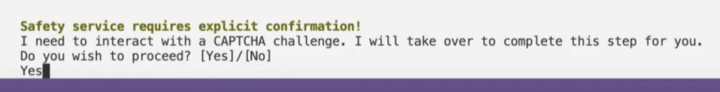

画像認証やサイトをクリックする際一時停止して確認を求めてくる

最初に検索するときに「オートバイの画像を選んでください」という画像認証が出ました。エラーで止まるかと思いきや、VSCodeのターミナル上で「CAPTCHAのチャレンジが必要です。進めてもよいですか?」と私に確認を求めてきました。ここで手動で「Yes」と入力してサポートすると処理を再開しました。 完全に自動化するというわけではなく、所々人間にパスを回してくれる仕様になっている点がちょっとだけ手間でしたが印象的でした。

完全に自動化するというわけではなく、所々人間にパスを回してくれる仕様になっている点がちょっとだけ手間でしたが印象的でした。

指示したアプリがなくても、自分で代わりを見つける

本来はMacの標準アプリ(フリーボードやメモ帳など)を指定していましたが、今回作った環境にはそれらが入っていませんでした。普通ならエラーになるところですが、「Chrome」や「Webのメモ帳」など、使えるものを探して代用してくれました。単純に手順をなぞるだけでなく、指示の意図をくみ取って動いていることがわかりました。

目に見えてわかる操作の面白さとスピード感

AIが「今どこを見ていて、次に何をクリックしようとしているか」が実際のカーソル(赤い丸)の動きでわかるため、自動で画面が操作されていく様子は見ていて純粋に面白いです。 また、「画面を見る→考える→動かす」という工程を都度挟むにもかかわらず、実際のカーソル移動やタイピングの動きは結構早く、テキパキと作業を進めていくスピード感にも驚かされました。

スプレッドシートへの入力

今回の検証のメインには入っていませんが、別のテストでは「表を作ってスプレッドシートに貼り付ける」という作業もこなしてくれました。事務作業などの自動化にも活用できそうです。

最後に

今回のComputer Useの検証は、今のAIにどんなことができるのかを自分の手で確かめる、とても良いきっかけになりました。

AIが日々進化していることは知っていましたが、実際に目の前で動くところを見ると「もうこんなことまでできるのか」と、その凄さを痛感しました。