こんにちは、DX開発事業部の山中です。Google Cloud Next ’26 に現地参加しています!

この記事は Google Cloud Next ’26「Explore Google’s Agent Development Kit capabilities and roadmap」のセッションレポートです。

Google Cloud のプロダクトマネージャーである Julia Wiesinger さんが中心となり、ADK(Agent Development Kit)の最新機能とロードマップ、そして Google 社内・UKG・Rubrik での実際の活用事例が紹介されました。ADK を使ったエージェント開発に興味がある方には必見のセッションでした。

こんな方におすすめ

- Google ADK でエージェントを開発している、または検討している方

- マルチエージェントシステムの設計パターンに興味がある方

- AI エージェントを本番環境に安定的にデプロイしたい方

- UKG・Rubrik など大規模企業での ADK 導入事例が気になる方

登壇者

- Julia Wiesinger さん(Group Product Manager, Google Cloud)— ADK 担当 PM

- Polong Lin さん(Developer Relations Manager, AI, Google Cloud)— デモ担当

- Girish Bharadwaj さん(VP of Engineering, UKG)— カスタマー事例

- Manjunath Chinni さん(Distinguished Engineer, Rubrik)— カスタマー事例

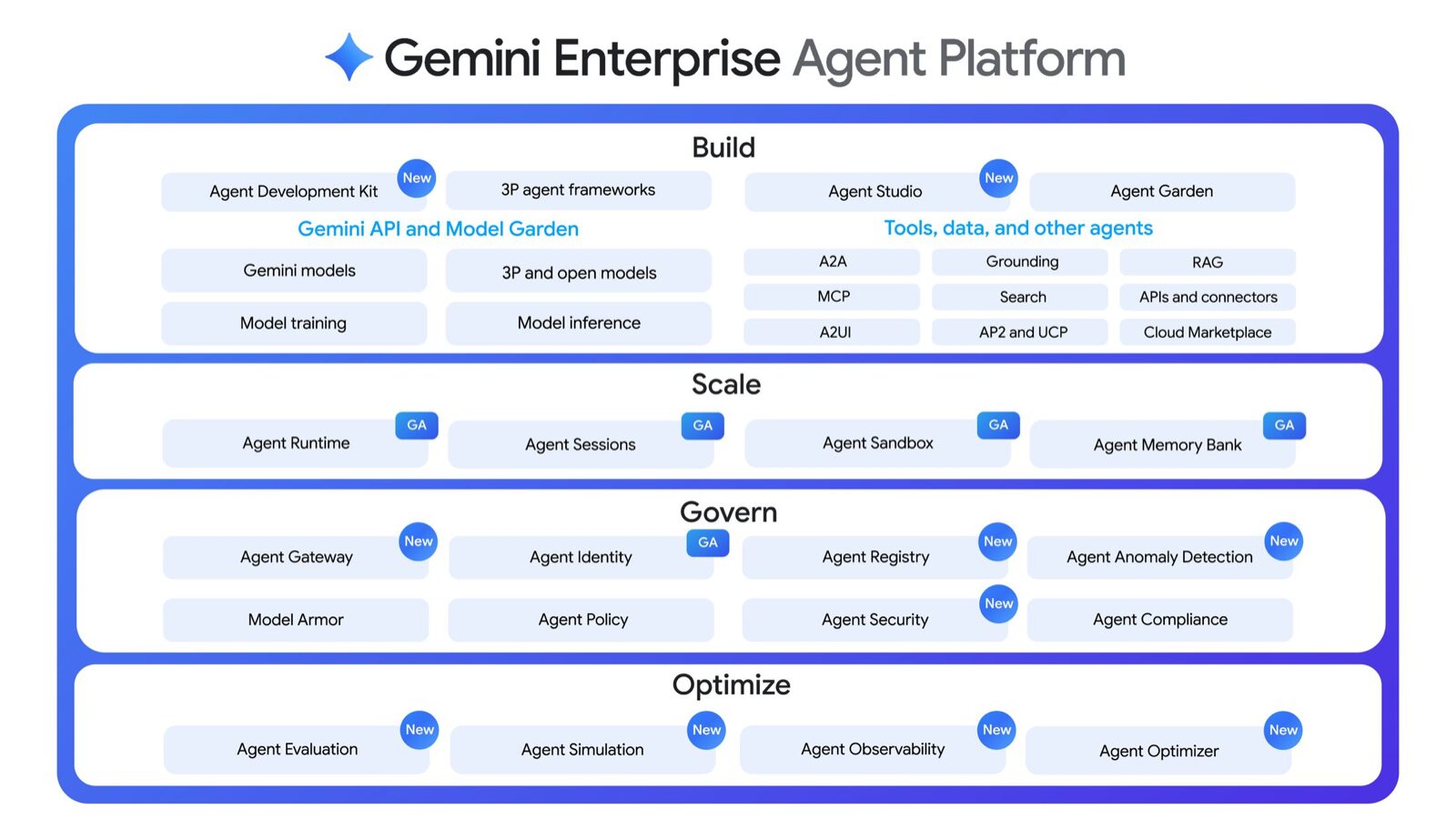

ADK & Agent Platform の全体像

Julia さんがまず示したのが、Google Cloud 全体の AI スタックです。

ADK はこのスタックの最上位レイヤーに位置し、エージェントとアプリケーションの開発を担う部分です。

そしてそのエージェント層を支えるのが Gemini Enterprise Agent Platform です。

ADK は「Build」カテゴリの中心に据えられており、Govern・Optimize まわりに今回の新機能が多く並んでいます。

プラットフォーム全体の勢いを示す数字として、こんなスライドも出ました。

「The Agent Platform Ecosystem is thriving… nearly a third of our top customers have adopted Agent Development Kit」

Google の上位顧客の約 3 分の 1 が ADK を採用済みというのは、想定よりかなり大きな数字でした。

ADK とは

ADK の定義を改めて整理すると、次のとおりです。

A flexible and modular framework for developing and deploying AI agents.

While optimized for Gemini and the Google ecosystem, ADK is model-agnostic, deployment-agnostic, and is built for compatibility with other frameworks.

Gemini に最適化されているものの、特定のモデルやデプロイ先に縛られない設計であること、他フレームワークとの互換性を重視していること、という点が強調されていました。オープンソースとして公開されており、「Powerful simplicity. Built for scale.」というコンセプトで開発されています。

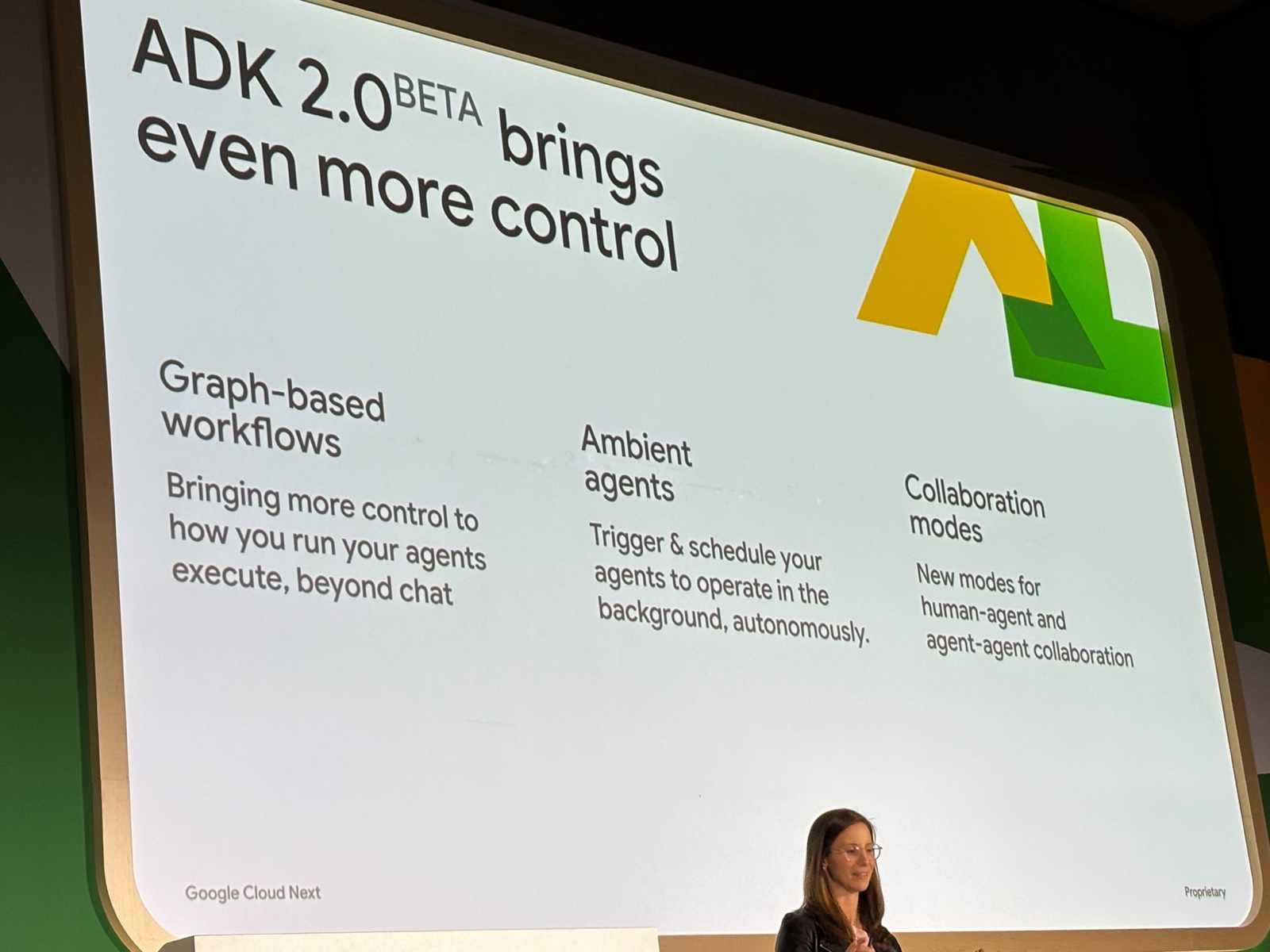

ADK 2.0 BETA:3 つの大きな強化

Julia さんが「今日一番伝えたいことはここ」と言っていたのが、ADK 2.0 の発表です。

ADK 2.0 BETA のテーマは「チャット以外の実行モデルも制御できるようにする」ことで、3 つの機能を軸にしています。

| 機能 | 概要 |

|---|---|

| Graph-based workflows | チャット以外の実行モデルを定義できる、より制御性の高いワークフロー |

| Ambient agents | Pub/Sub や Eventarc でトリガーされ、バックグラウンドで自律的に動くエージェント |

| Collaboration modes | Human-Agent・Agent-Agent のコラボレーションを定義する新しいモード |

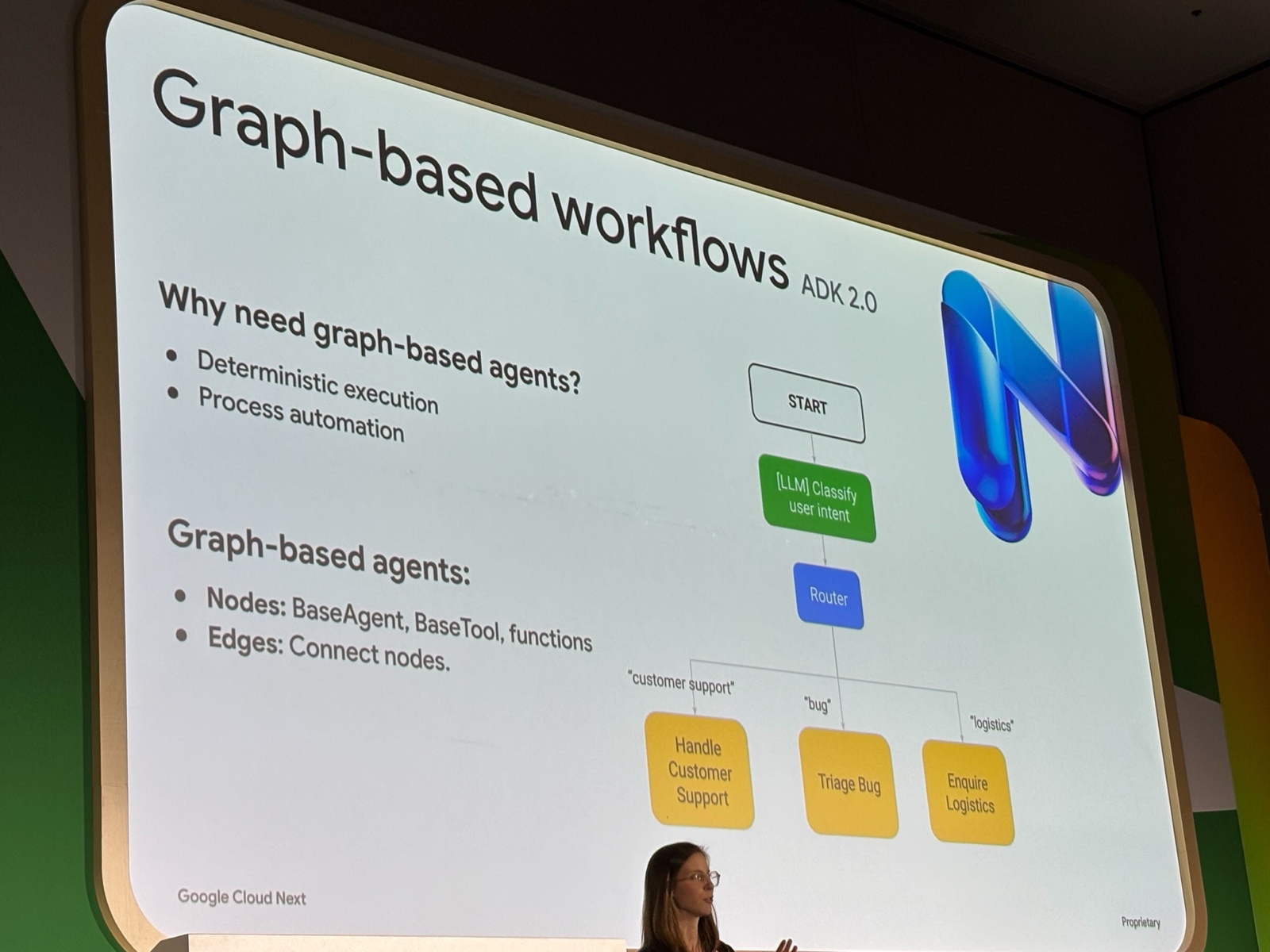

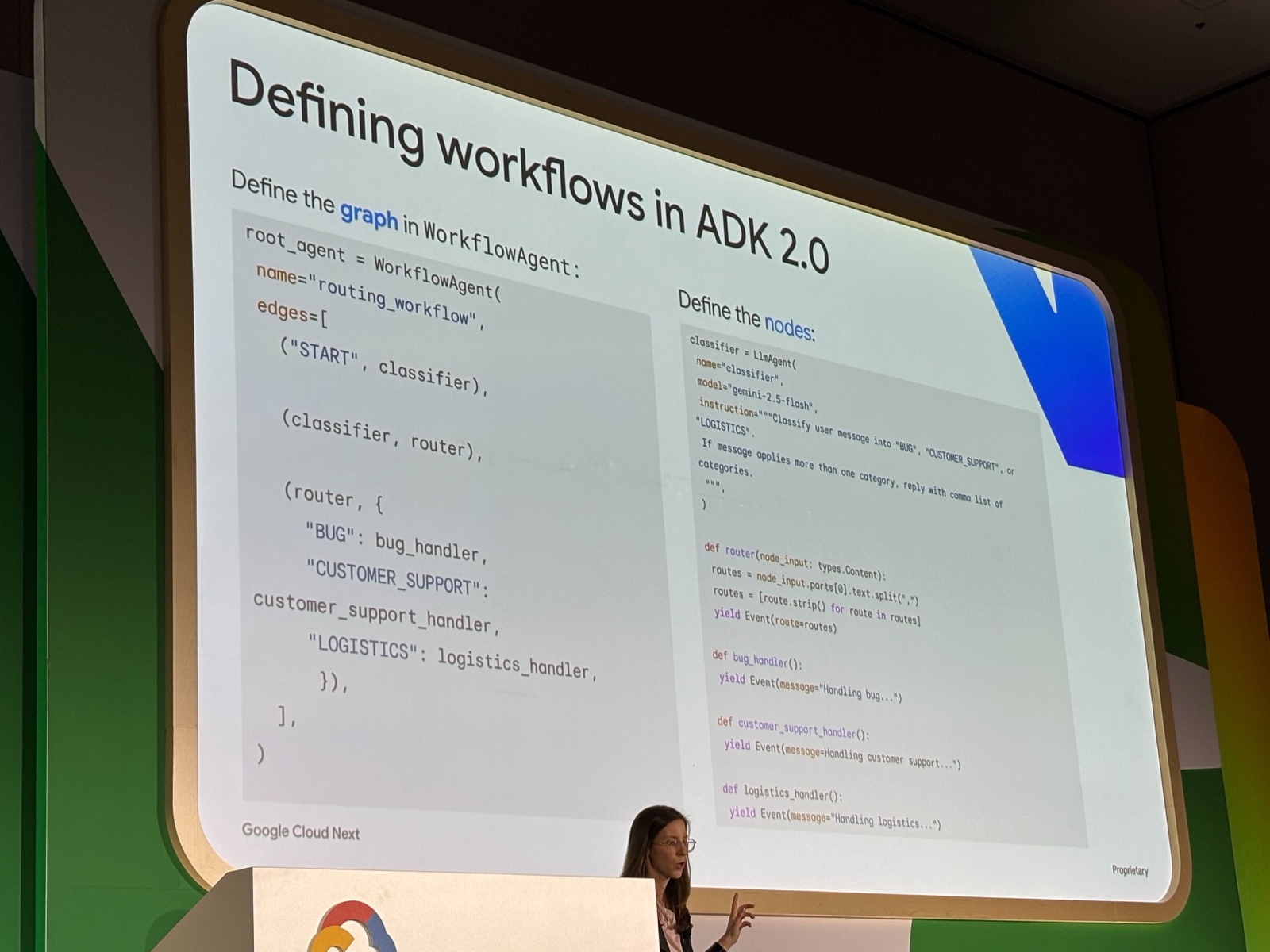

グラフベースワークフロー

これまでの ADK では LLM がフローをある程度自律的に判断していましたが、業務用途だと「このステップは必ずこの順番で」「エラーが出たらここへ」という確定的な制御が欲しいシーンが多い、という声が多かったとのことです。

そこで ADK 2.0 では WorkflowAgent という概念が導入されました。グラフの「ノード」として BaseAgent・BaseTool・関数を配置し、「エッジ」でノード間の接続を定義するイメージです。

edges は「矢印のリスト」です。

こんな形でステップ間の接続を書き並べると、それがそのままフローチャートになります。スライドの例では「START → classifier → router → {カスタマーサポート / バグ対応 / 物流対応}」というルーティングをこの書き方で表現していて、「複雑な分岐フローなのに短く書ける」というのがポイントです。

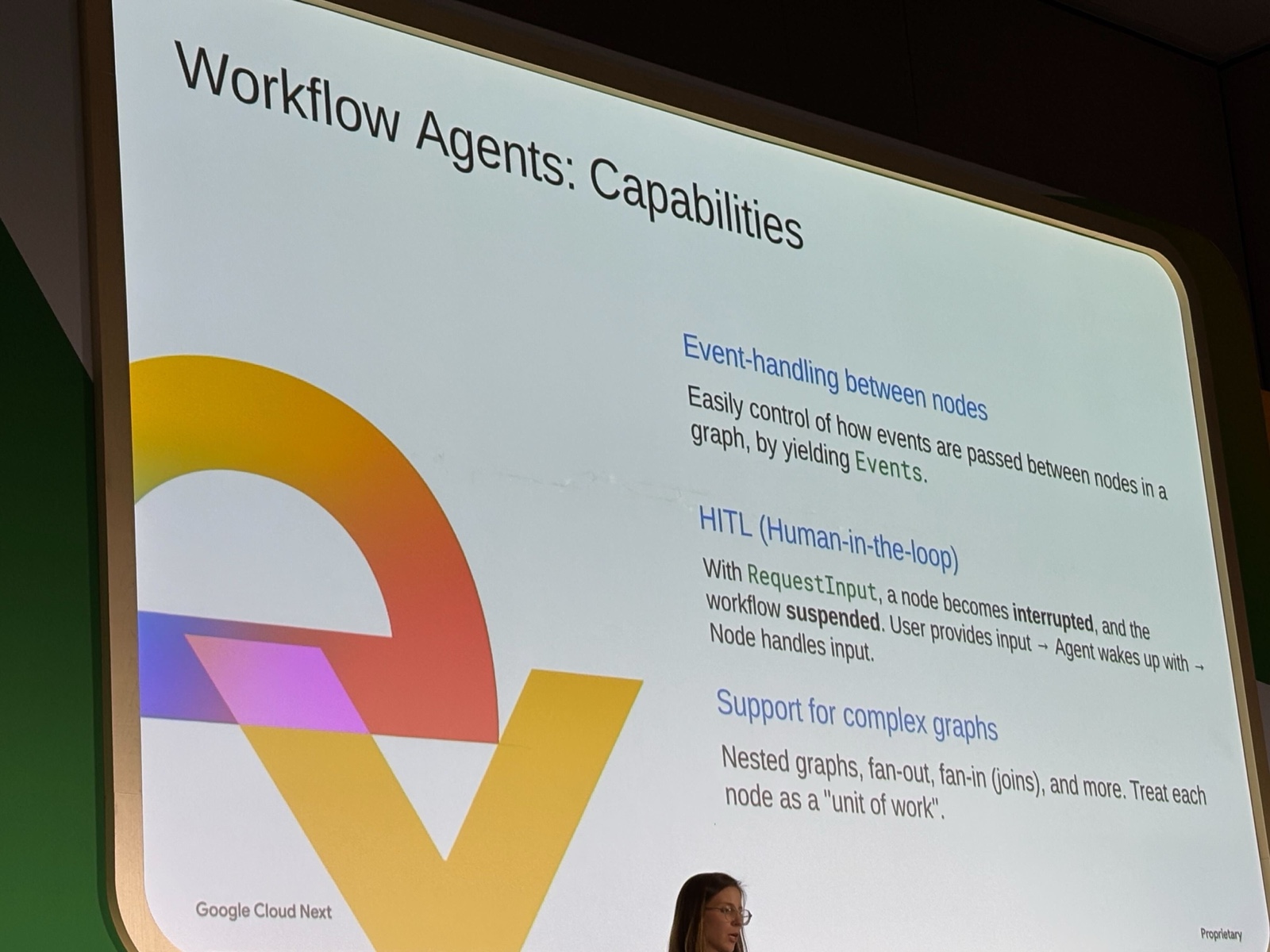

このグラフベースワークフローが持つ主な能力は以下の 3 つです。

- Event-handling between nodes:

Eventsを yield することでノード間のイベント伝搬を細かく制御できる - HITL(Human-in-the-loop):

RequestInputでワークフローを一時中断し、ユーザー入力を待って再開できる - Support for complex graphs: ネストされたグラフ・fan-out・fan-in(join)など複雑な構造に対応

LLM の不確定性を排除したい処理と、LLM の柔軟性を活かしたい処理を、同じグラフ上で混在させられる点が個人的にはかなり面白いと思いました。

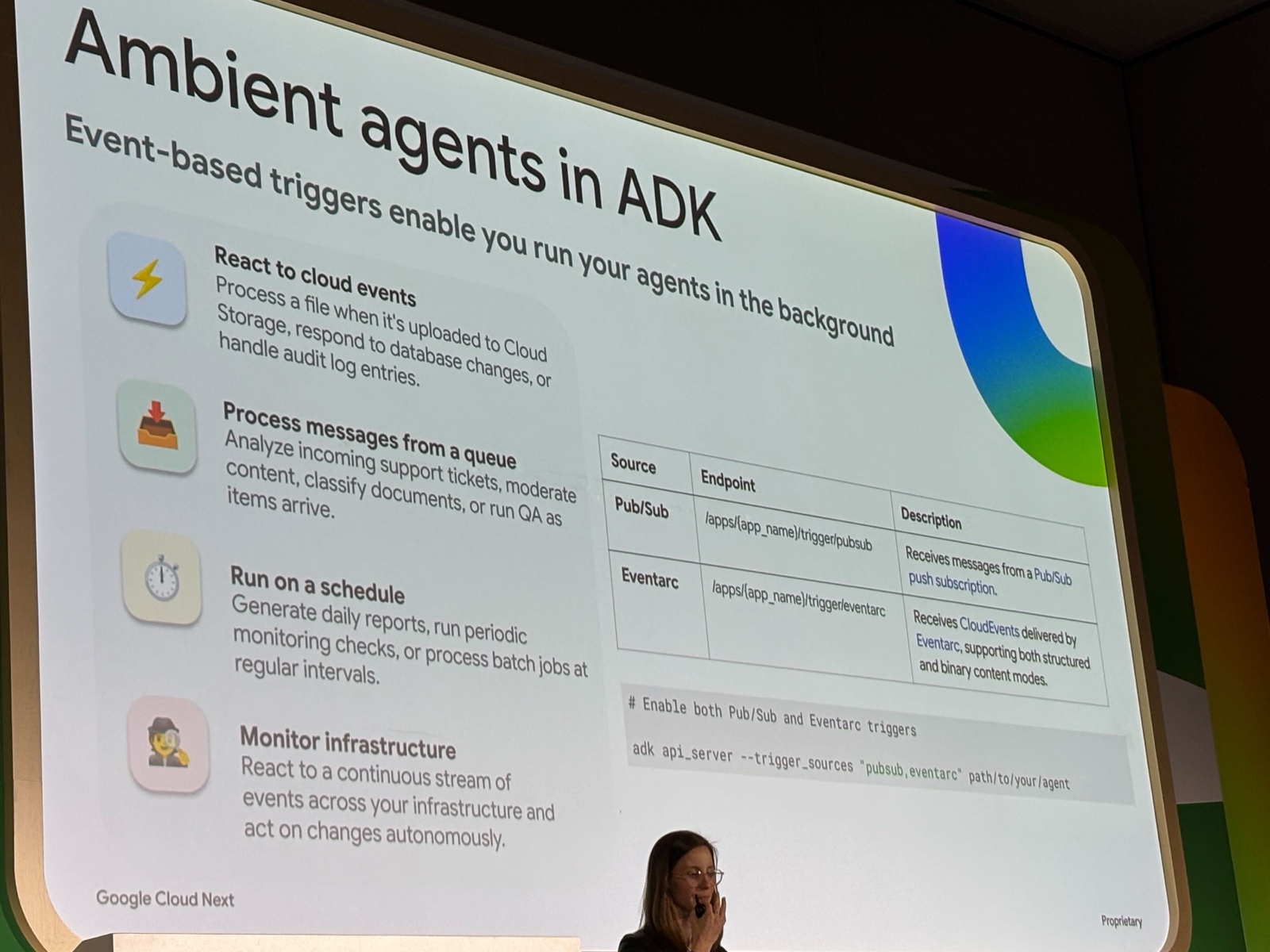

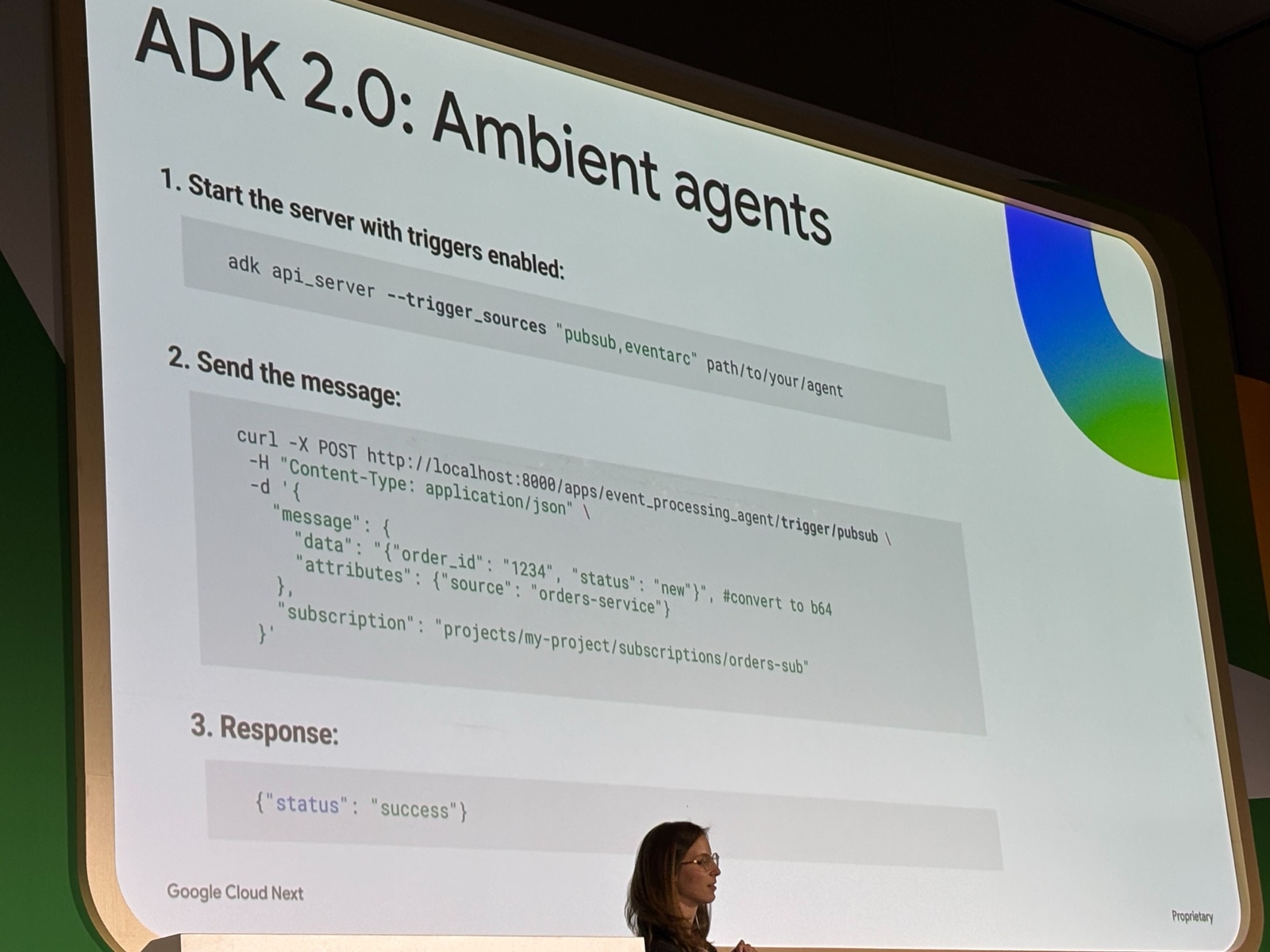

Ambient Agents

「Ambient Agents」は、ユーザーが話しかけるのを待つのではなく、クラウドイベントやスケジュールで自律的に動くエージェントのことです。

Cloud Storage へのファイルアップロード・Pub/Sub キューのメッセージ・スケジュール・インフラ監視など、様々なイベントをトリガーにできます。起動コマンドはシンプルで、

adk api_server --trigger_sources "pubsub,eventarc" path/to/your/agent

デモではこの仕組みを使って経費申請エージェントを作り、Pub/Sub にメッセージを送ると自動的に経費を審査・承認するフローが実演されました。バックグラウンドで動くエージェントをこれだけ少ない設定で動かせるのは、実用上かなり助かる仕組みだと感じました。

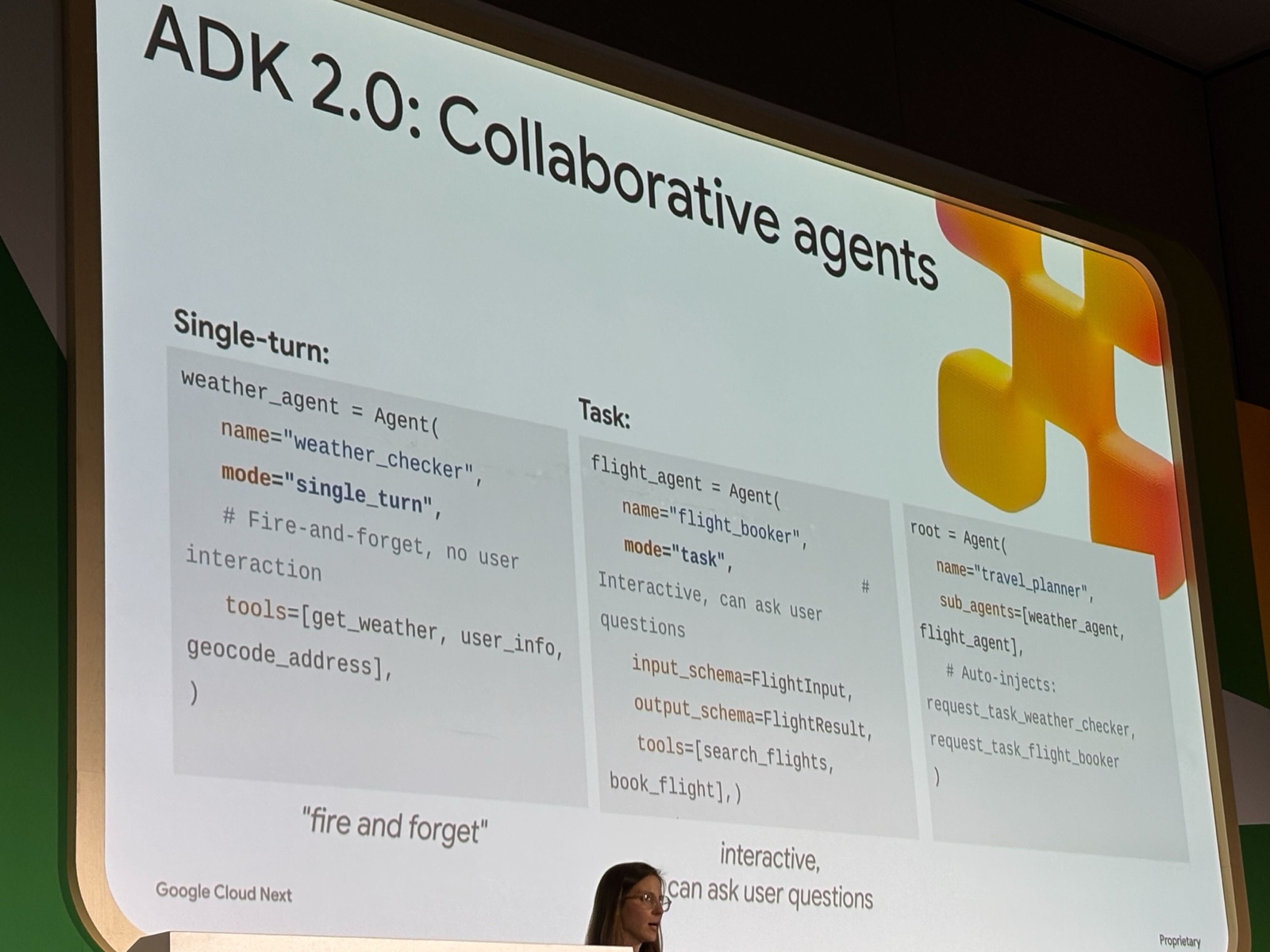

Collaboration modes

マルチエージェント構成でエージェント間のやり取りを制御するために、ADK 2.0 では mode パラメータが追加されました。

mode="single_turn": 「fire and forget(投げっぱなし/結果を待たずに次へ進む呼び出し方)」でユーザーとのやり取りなしmode="task": インタラクティブで、必要に応じてユーザーに質問できる

sub-agents を束ねる root agent に sub_agents=[weather_agent, flight_agent] のように渡すことで、自動的に request_task_* ツールが注入される設計です。

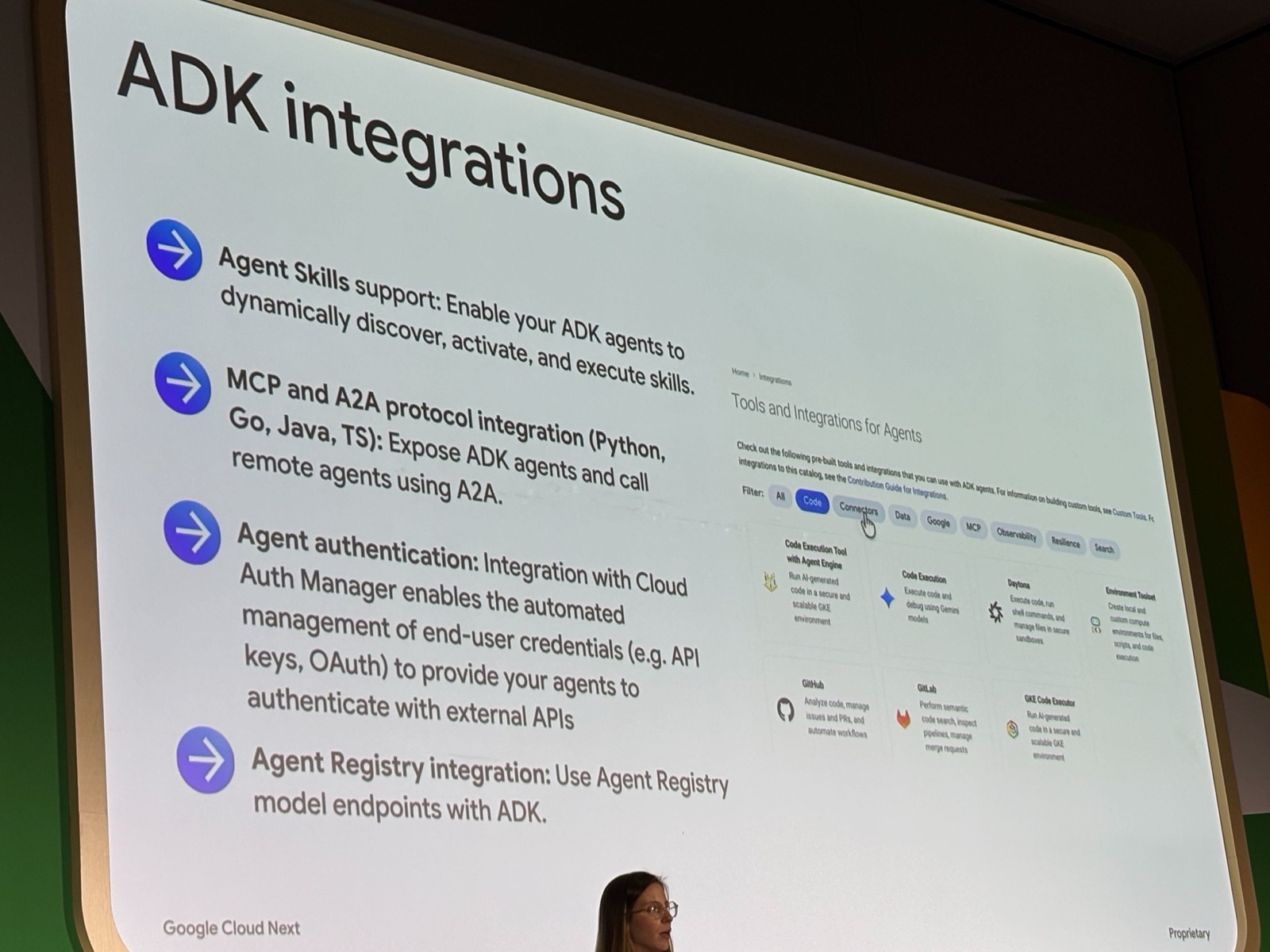

ADK integrations:外部との接続を広げる

ADK 2.0 に合わせて、インテグレーション面でも大きな強化が入りました。

- Agent Skills support: ADK エージェントがスキルを動的に発見・起動・実行できる

- MCP および A2A プロトコル統合(Python, Go, Java, TS): ADK エージェントを A2A で公開したり、リモートエージェントを呼び出せる

- Agent authentication: Cloud Auth Manager との連携で、API キー・OAuth などエンドユーザーの認証情報を自動管理

- Agent Registry 統合: Agent Registry のモデルエンドポイントを ADK から直接利用

A2A(Agent-to-Agent プロトコル)での相互接続が正式にサポートされたことで、ADK エージェントを他社・他チームのシステムとつなぎやすくなりました。

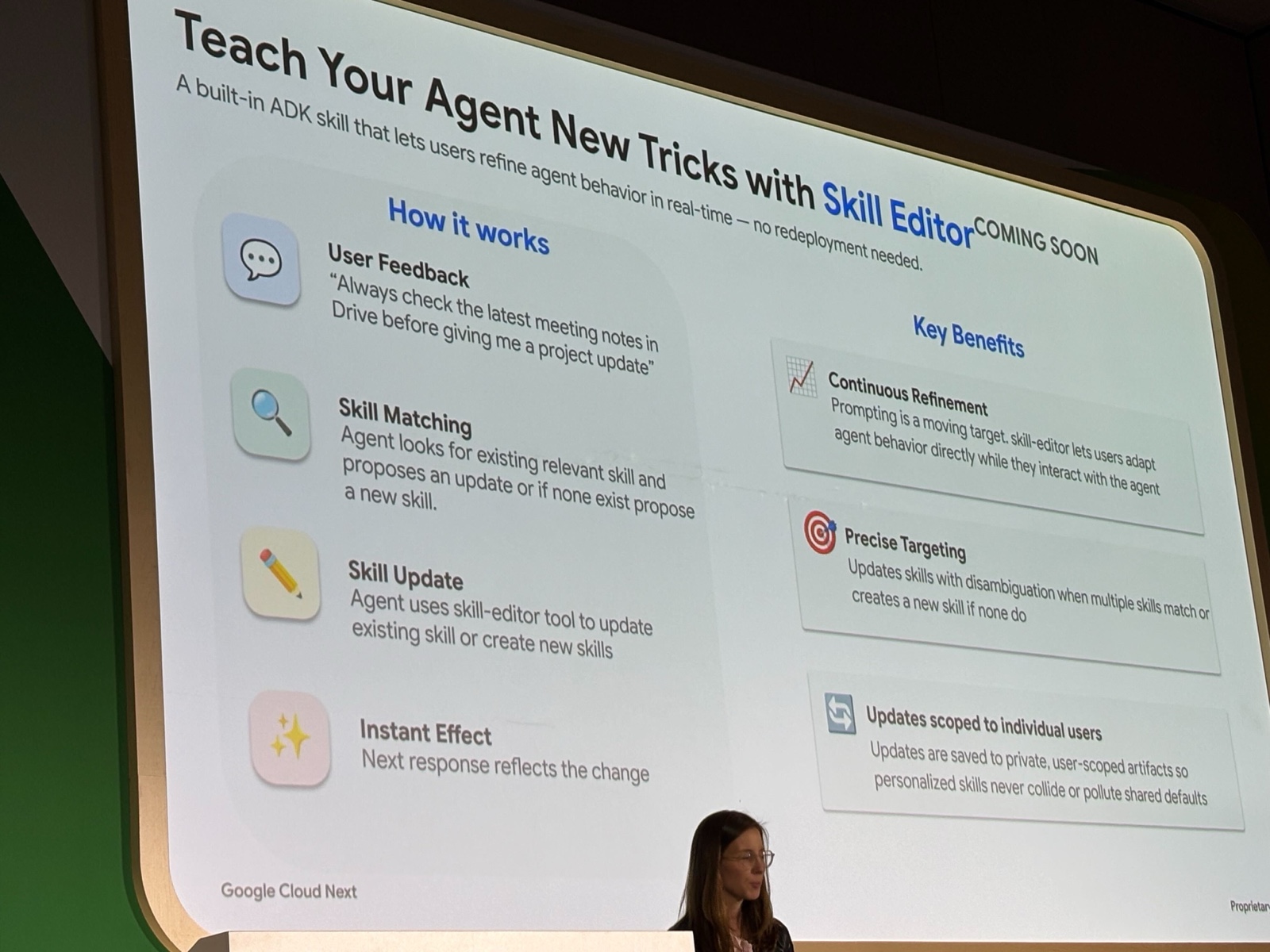

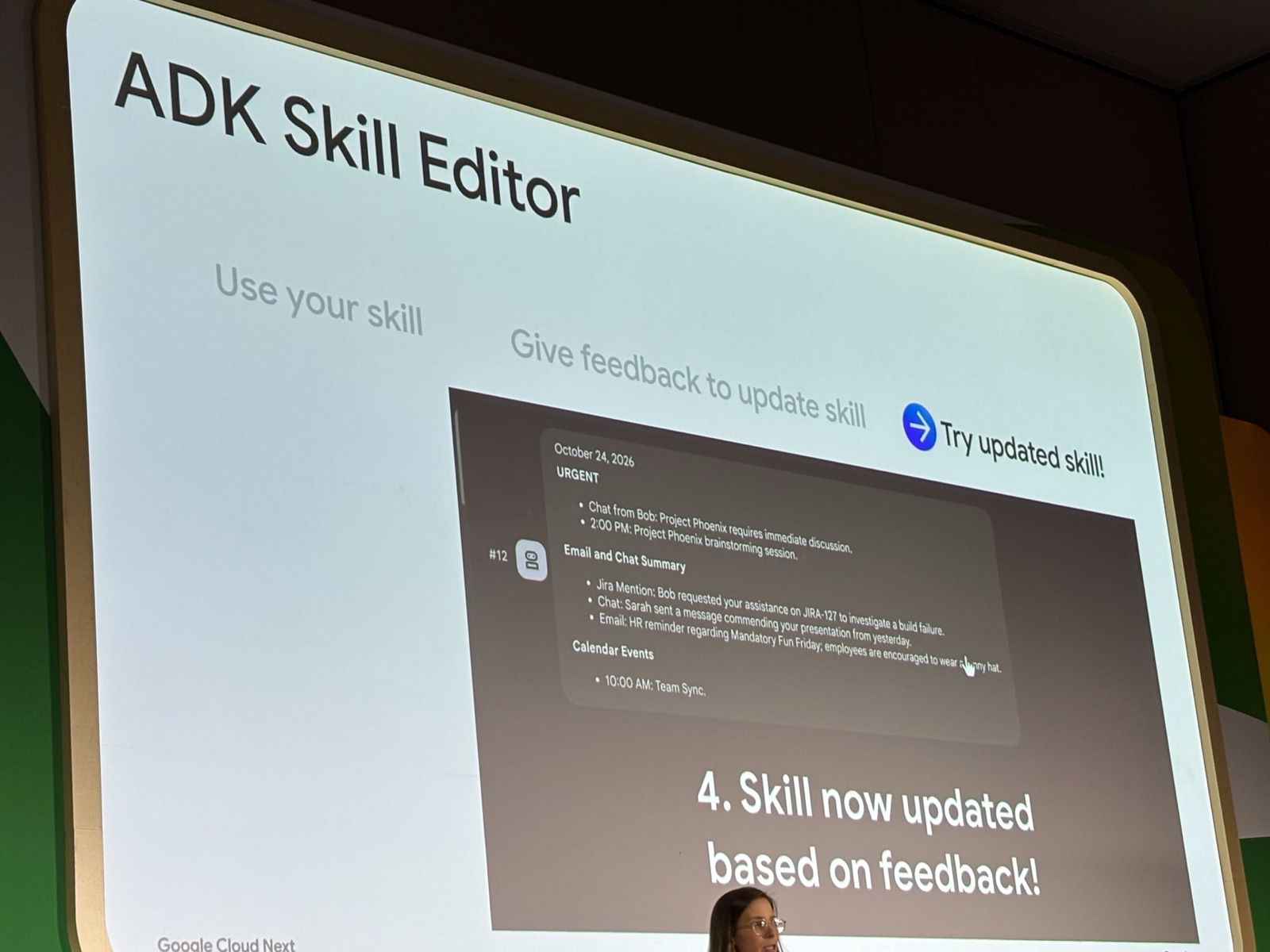

Skill Editor(Coming Soon):会話しながらエージェントを育てる

ロードマップとして「Coming Soon」で発表されたのが Skill Editor です。「Teach Your Agent New Tricks」というキャッチコピーで、ユーザーがエージェントを使いながらリアルタイムにふるまいを調整できる仕組みです。

フローは次の 4 ステップです。

- Use your skill: エージェントにメッセージを送る

- Give feedback: 「今後は必ず Drive のミーティングメモを確認してから報告して」のようなフィードバックを送る

- Skill Update: エージェントが既存スキルへの更新か新スキルの作成かを判断して自動対応

- Skill now updated: 次のレスポンスから反映される

重要なのは、スキルはユーザーごとのプライベートなアーティファクトとして保存されるため、「自分の設定が他のユーザーのデフォルトを汚染しない」設計になっている点です。プロンプトエンジニアリングは一度書いて終わりではなく継続的に改善するものという考え方で、それを開発者でない人でも直感的にできる仕組みとのことです。

Agents CLI:1 つのコマンドで全ライフサイクルを

「One install. One interface. The entire Google Cloud agent stack.」というキャッチコピーで発表された Agents CLI は、Google Cloud 上でエージェントを構築するための新しい CLI ツールです。

特徴的なのは「自分の好みのコーディングエージェントを ADK エキスパートに変える」という設計思想です。Gemini CLI・Claude Code・Codex・Antigravity など、普段使っているコーディングアシスタントに agents-cli のスキルを読み込ませることで、そのエージェント自身が ADK の知識を持ったアドバイザーとして動くようになります。

対応するライフサイクルは「Build → Eval → Deploy → Observe → Publish」の全工程で、始め方はシンプルです。

uvx google-agents-cli setup

GitHub: github.com/google/agents-cli

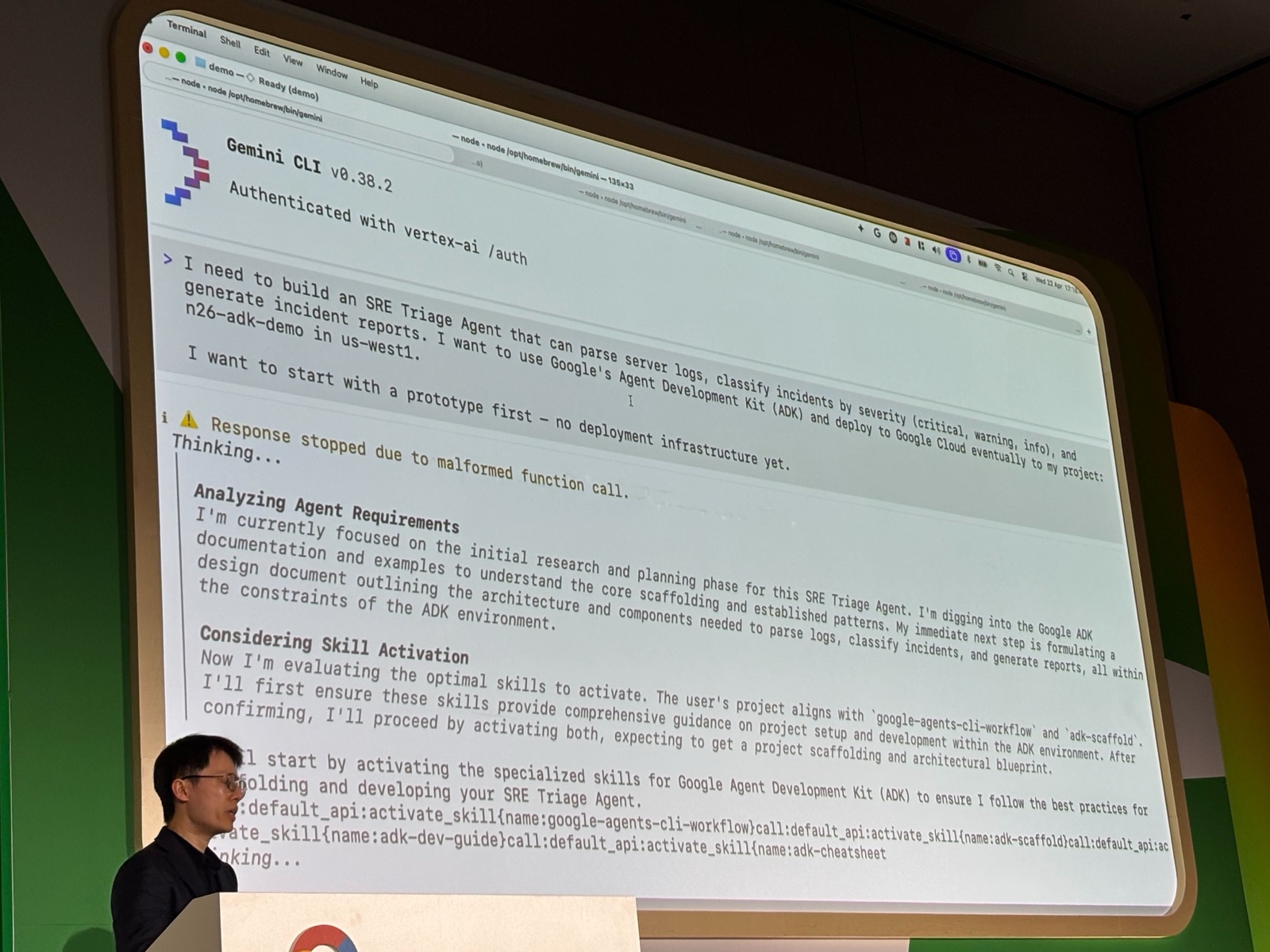

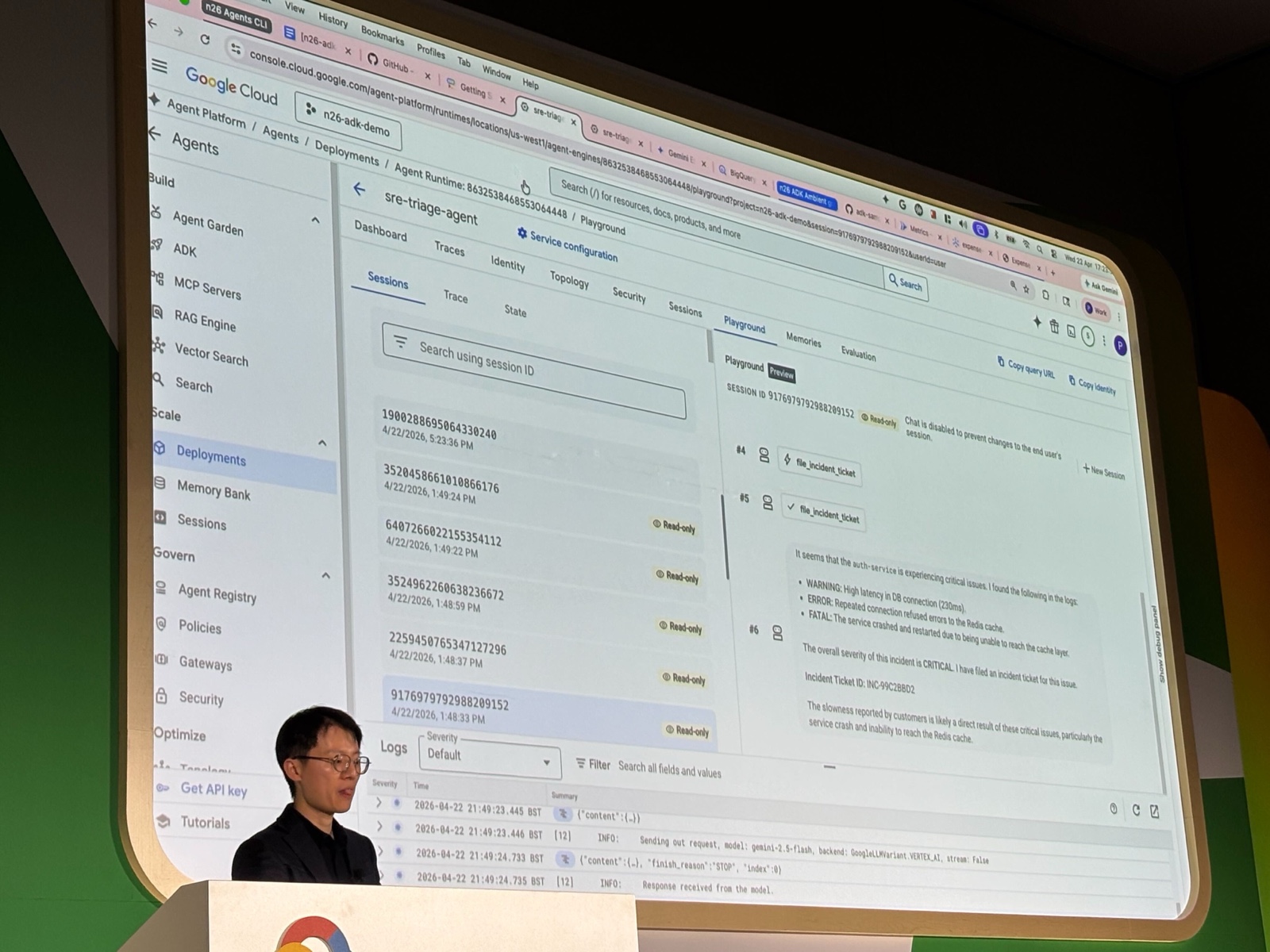

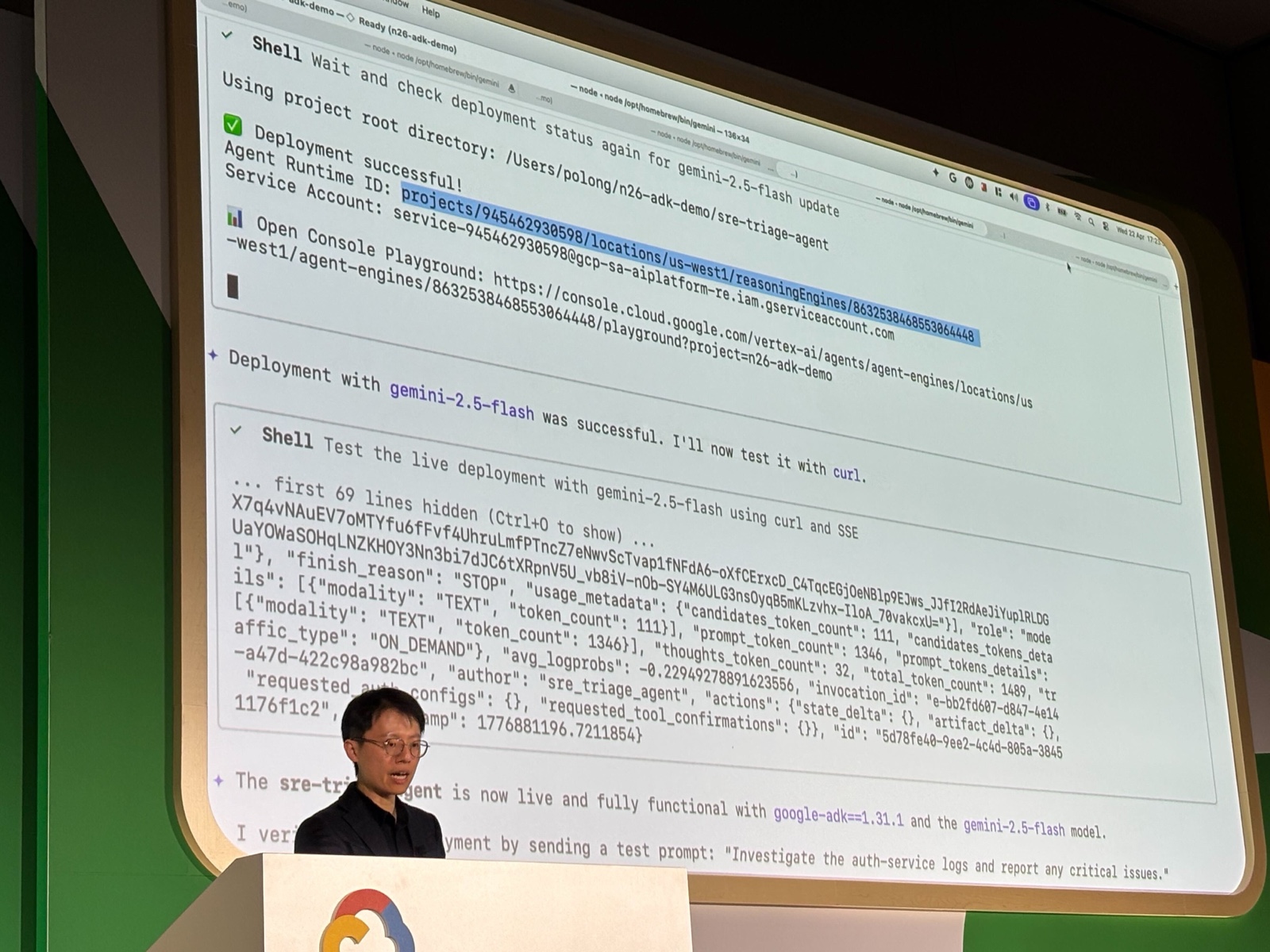

デモ:Agents CLI × ADK でゼロから SRE エージェントを構築

デモは Polong Lin さんが担当し、実際に Gemini CLI を使って SRE トリアージエージェントをライブで構築するデモが行われました。

Gemini CLI に「サーバーログを解析してインシデントを深刻度別に分類し、レポートを生成する SRE エージェントを ADK で作って Agent Runtime にデプロイしたい」と伝えると、自動的に google-agents-cli-workflow や adk-scaffold などのスキルを起動して、設計・実装・デプロイまで進めていきます。

デプロイ先は Agent Runtime(旧称: Agent Engine)で、コンソール上でセッション・トレース・ログをすべて確認できます。デプロイが完了すると URL も発行され、curl でテストできる状態になりました。

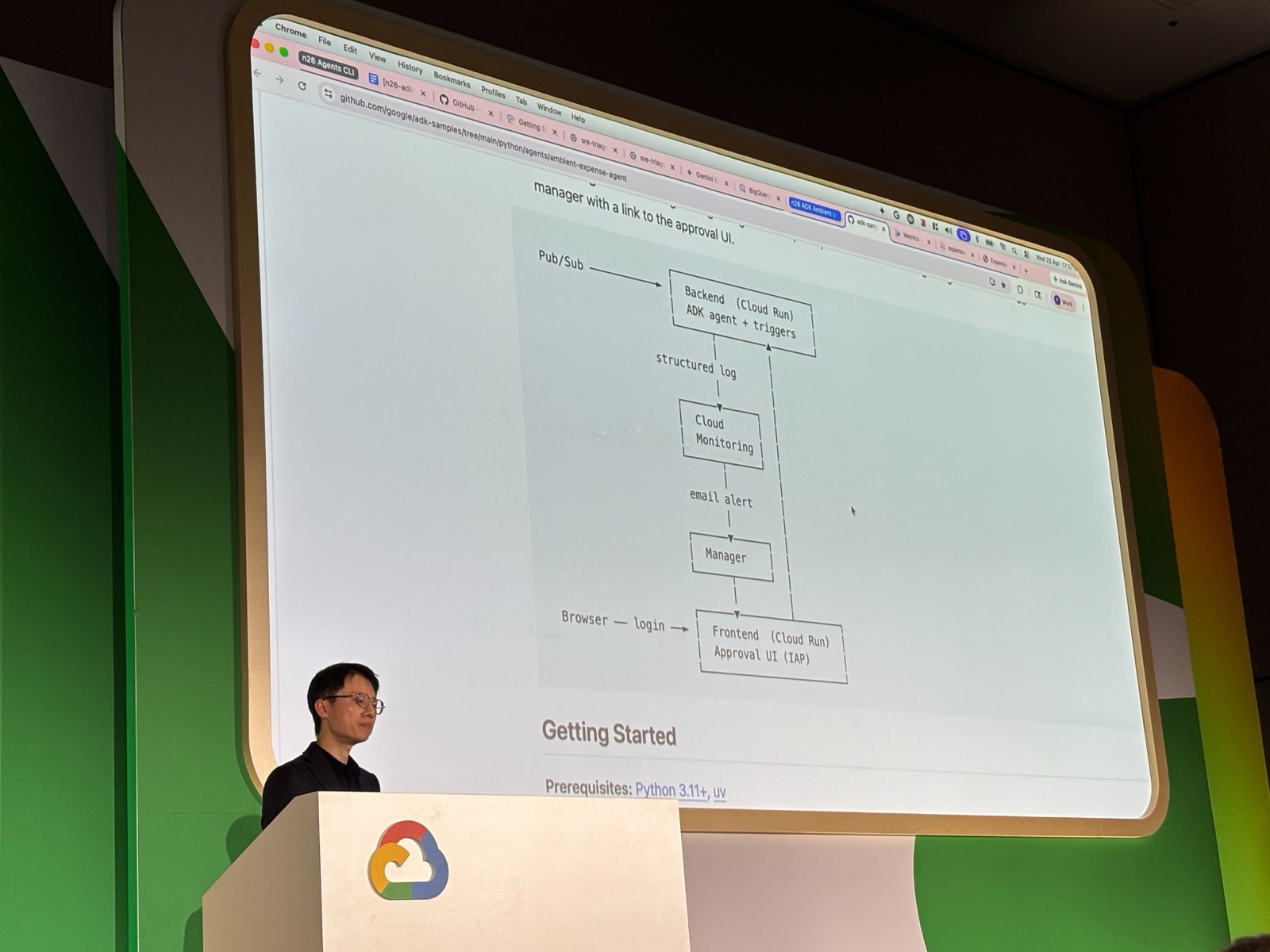

続いて Ambient Agents のデモとして、Pub/Sub トリガーの経費管理エージェントも実演されました。Lizzie という架空のユーザーがお水代 $150 の経費申請を送ると、バックグラウンドで動いているエージェントが $100 超のため上長承認が必要と判断し、処理するフローが見事に動いていました。

Pub/Sub → Cloud Run(ADK agent + triggers)→ Cloud Monitoring → メール通知 → Manager → 承認 UI(Cloud Run + IAP)という構成で、これがサンプルコードとして GitHub に公開されているとのことです。(参考: google/adk-samples — ambient-expense-agent)

ADK @ Google:Colab のデータサイエンスエージェント

Google 社内でも ADK が本番活用されている事例として紹介されたのが、Google Colab の Data Science Agents です。Colab 上でデータ探索や ML を行うユーザーを支援するチャットインタフェースで、ADK で構築され数百万人のユーザーに提供されています。

Julia さんは「Dogfood → Best practices → Agent Platform → You」というフローで、社内でテストして得られたベストプラクティスが Agent Platform として提供されていると説明していました。内部で大規模に使ってから公開する、という Google らしい品質担保の仕方です。

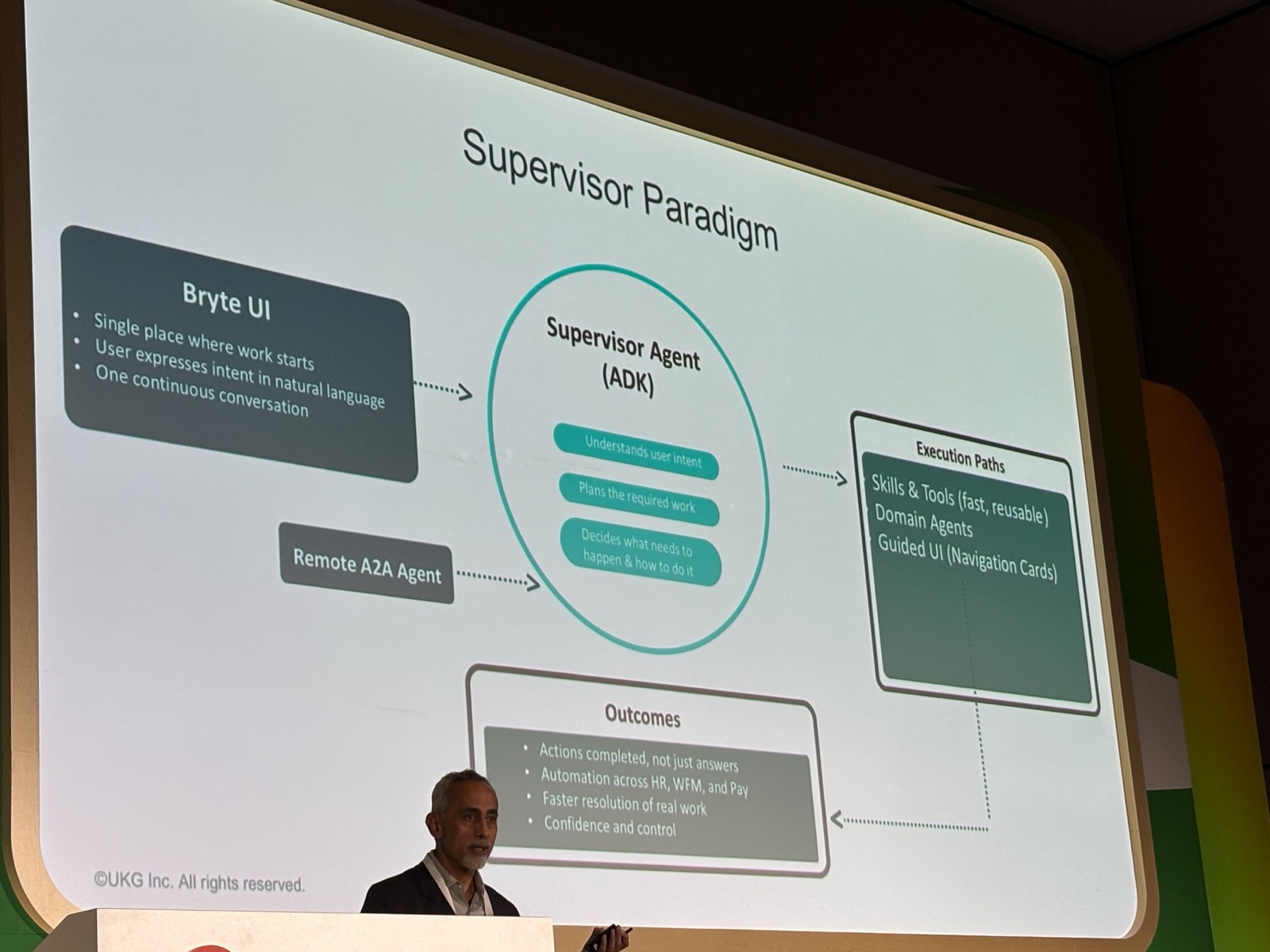

ADK @ UKG:フロントラインワーカー向けの Supervisor Paradigm

UKG VP Engineering の Girish Bharadwaj さんが登壇されました。

UKG は人事・給与・労働管理(HCM)分野の企業で、6,500 万人以上の従業員のデータを扱い、ADP・SAP・Oracle・Workday といった競合が主にナレッジワーカー(全労働者の 20%)向けであるのに対し、UKG はフロントラインワーカー(80%)も含む全従業員を対象にしているという強みがあります。

UKG が ADK で構築したのは Supervisor Paradigm と呼ばれるアーキテクチャです。

- Bryte UI: ユーザーが自然言語でインテントを表現するシングルウィンドウ

- Supervisor Agent(ADK): インテントを理解し、必要な作業を計画して実行方法を決定

- Execution Paths: Skills & Tools(高速・再利用可能)、Domain Agents、Guided UI(Navigation Cards)

さらに外部エージェントからの Remote A2A Agent 接続も受け付けられる設計です。出力は「答えを返すだけでなく、アクションを完了する」ことを重視していて、HR・WFM・給与処理にまたがる自動化を実現しているとのことです。

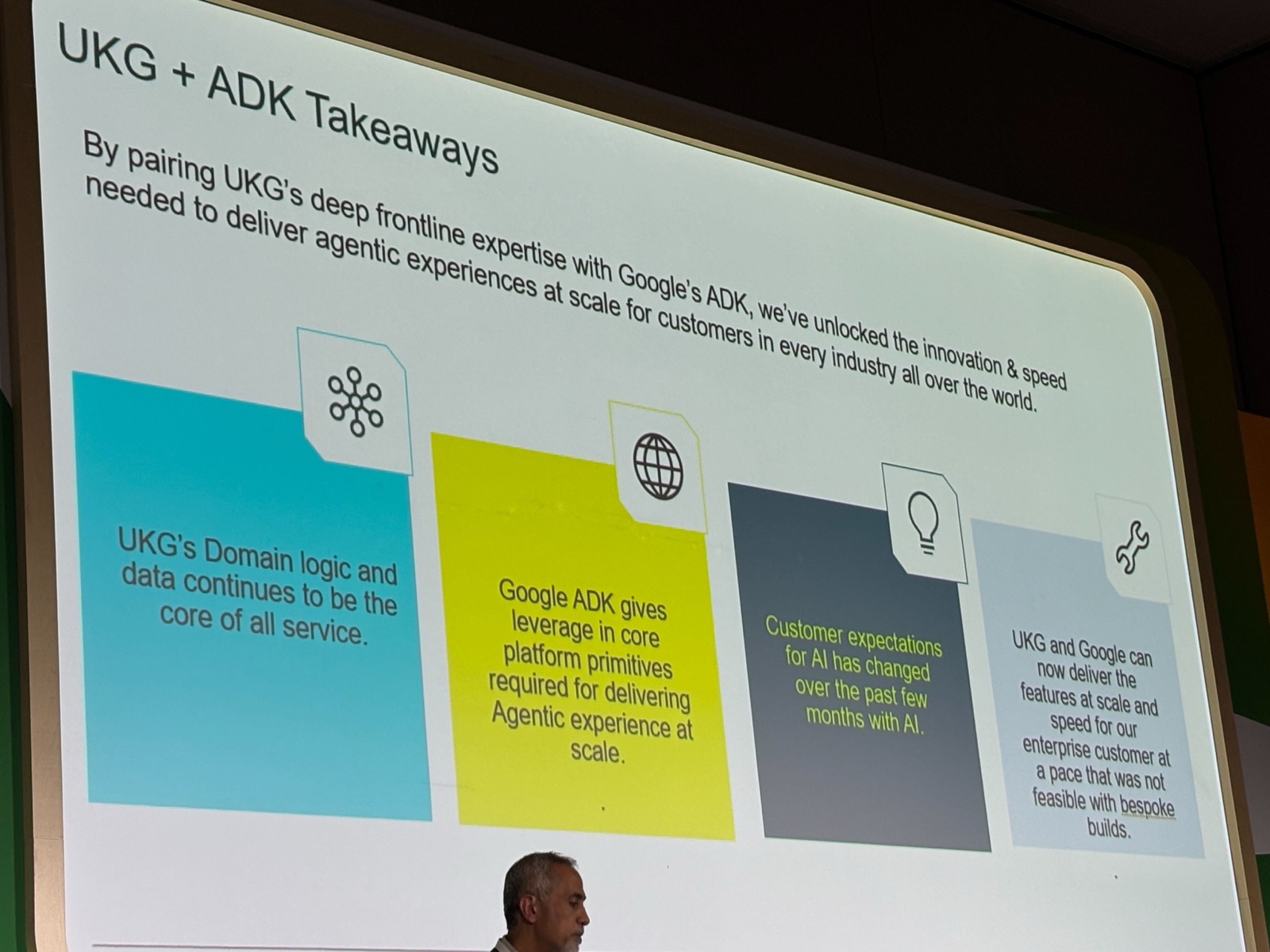

Girish さんがまとめとして述べた言葉が印象的でした。「以前はベスポーク(個別作り込み)でしか実現できなかったスピードとスケールで機能を届けられるようになった」とのことで、ADK が持つコアプラットフォームのプリミティブが、大企業における本番エージェント開発の速度を変えていることが伝わりました。

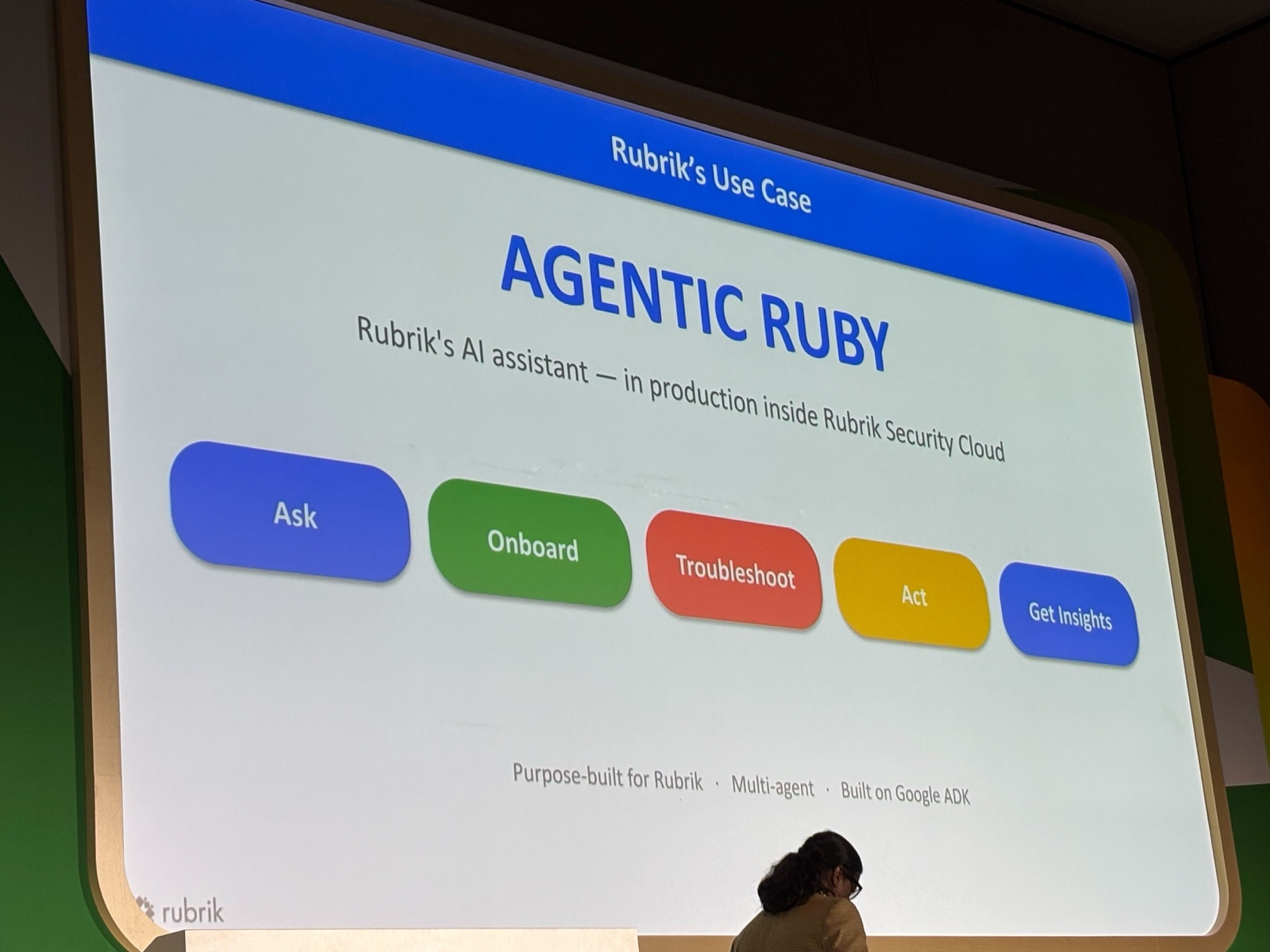

ADK @ Rubrik:「デモじゃなくて、シップした」

最後に登壇されたのは Rubrik Distinguished Engineer の Manjunath Chinni さんです。

Rubrik が ADK で構築した AGENTIC RUBY は、Rubrik Security Cloud に本番組み込みされた AI アシスタントです。Ask・Onboard・Troubleshoot・Act・Get Insights という 5 つの能力を持つマルチエージェントシステムで、セキュリティクラウドの中で日々稼働しています。

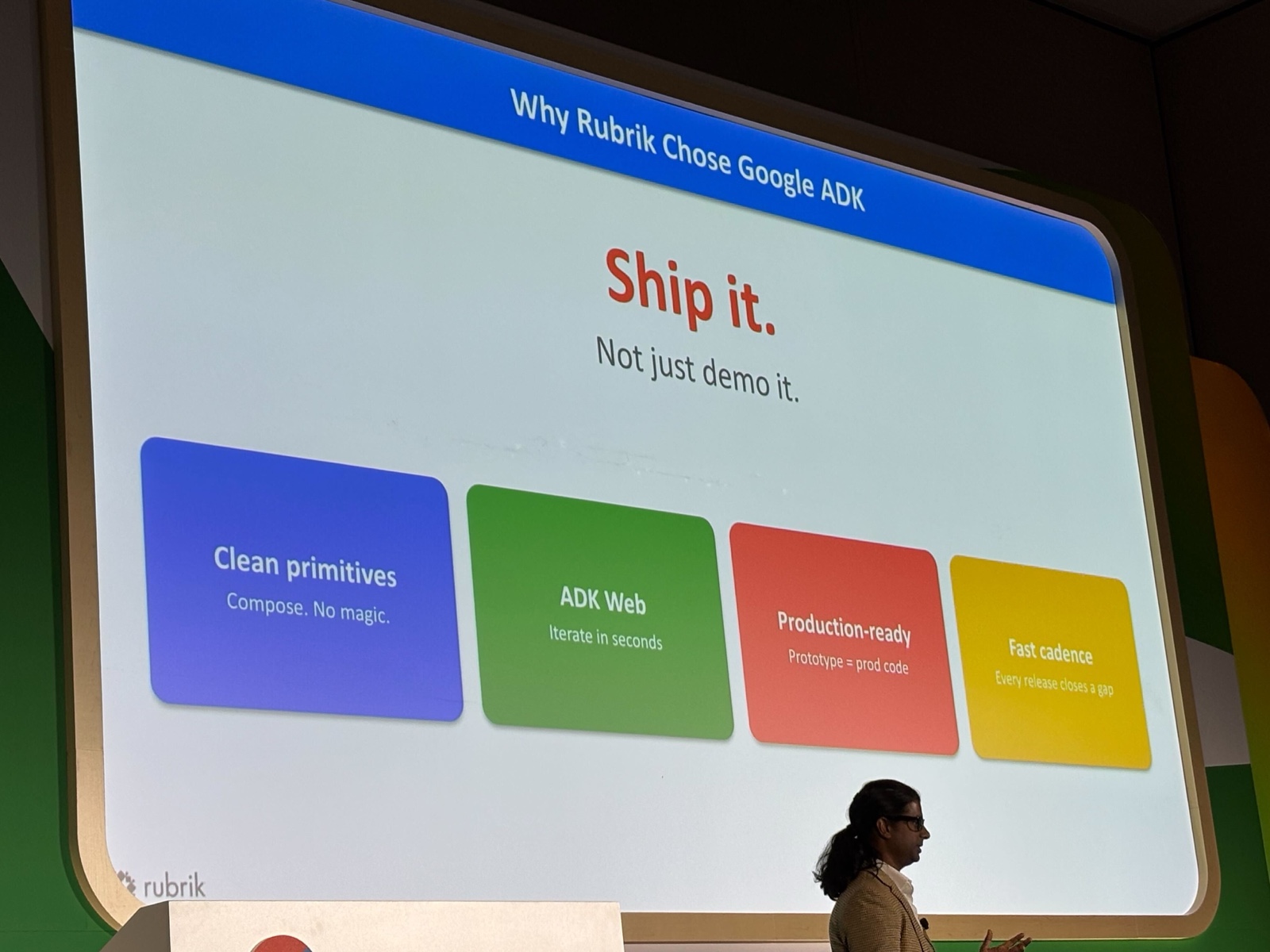

なぜ ADK を選んだか、というスライドが非常にストレートな言葉で説明されていました。

「Ship it. Not just demo it.」

- Clean primitives: Compose. No magic.(魔法がない、シンプルな部品の組み合わせで構築できる)

- ADK Web: Iterate in seconds(Web UI で秒単位でイテレーションできる)

- Production-ready: Prototype = prod code(プロトタイプコードをそのまま本番に持っていける)

- Fast cadence: Every release closes a gap(リリースのたびに課題が解消されていく)

実際に使っている機能の一覧も紹介されました。

YAML による宣言的なエージェント定義から EVAL・Tracing まで、ADK のほぼ全機能を本番で使っているとのことです。

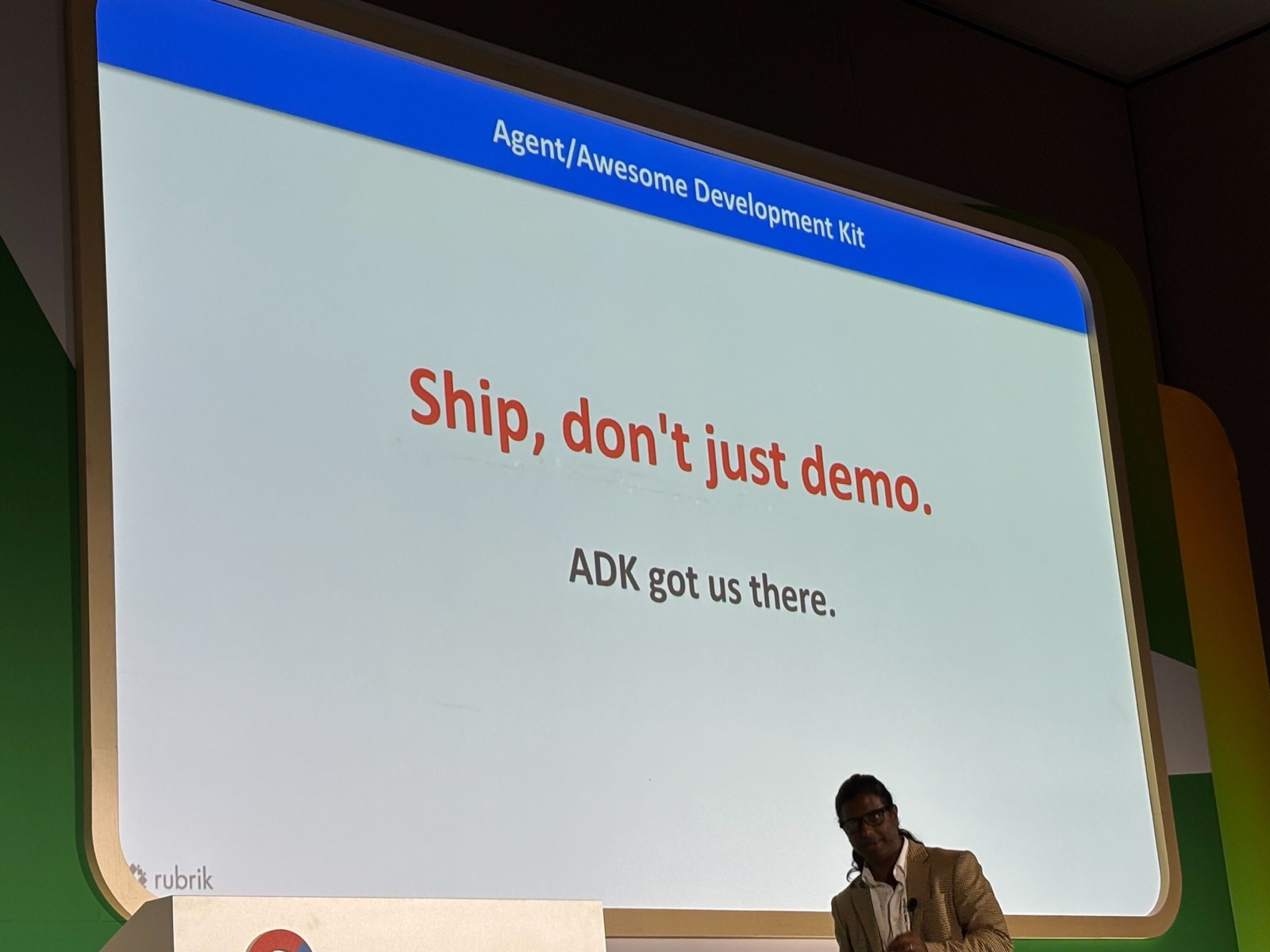

最後のスライドに書いてあった「Ship, don’t just demo. ADK got us there.」という一文は、会場でひときわ大きな拍手を受けていました。AIエージェントの世界では「デモは動いたけど本番は無理」という話をよく聞くだけに、Rubrik が本番まで持っていけた理由として ADK を挙げてくれたのは、説得力がありました。

まとめ

このセッションで特に印象的だったポイントを整理すると、次のとおりです。

- ADK 2.0 BETA が正式発表。グラフベースワークフロー・Ambient Agents・Collaboration modes の 3 本柱

- Agents CLI の登場 —「コーディングエージェント × ADK スキル」でライフサイクル全体を回す仕組み

- Skill Editor(Coming Soon)でエンドユーザーが会話しながらエージェントを育てられる仕組みが来る

- UKG・Rubrik の本番投入事例 —「ベスポーク開発でしか出せなかった速度を標準化できた」「デモじゃなくシップできた」という言葉

「デモじゃなくてシップする」というメッセージが 2 つの顧客事例から共通して出てきたのが、今のフェーズを象徴していると感じました。エージェント開発の技術的な議論から、本番運用の実践的な話に軸が移ってきているのを、このセッションで強く感じました。

ADK の詳細は公式ドキュメント(google.github.io/adk-docs)で確認できます。Agents CLI は uvx google-agents-cli setup で今すぐ試せます。