セッションタイトル

Agentic Threat Intelligence: Your new AI security teammate

はじめに

2025年は AI Agent にとってパラダイムシフトとも言える圧倒的な進化・浸透となった一年でした。非常に便利な AI Agent ですが、セキュリティの観点では考慮すべきことがあります。このブログでは、Google Threat Intelligence における生成AI(GeminiやVertex AI)の活用と、コストや監査要件に対応しながら自動運転のように段階的に進めるセキュリティ運用の自動化アプローチについて触れてみたいと思います。

完全自動化の罠?AIエージェントがもたらすリスク

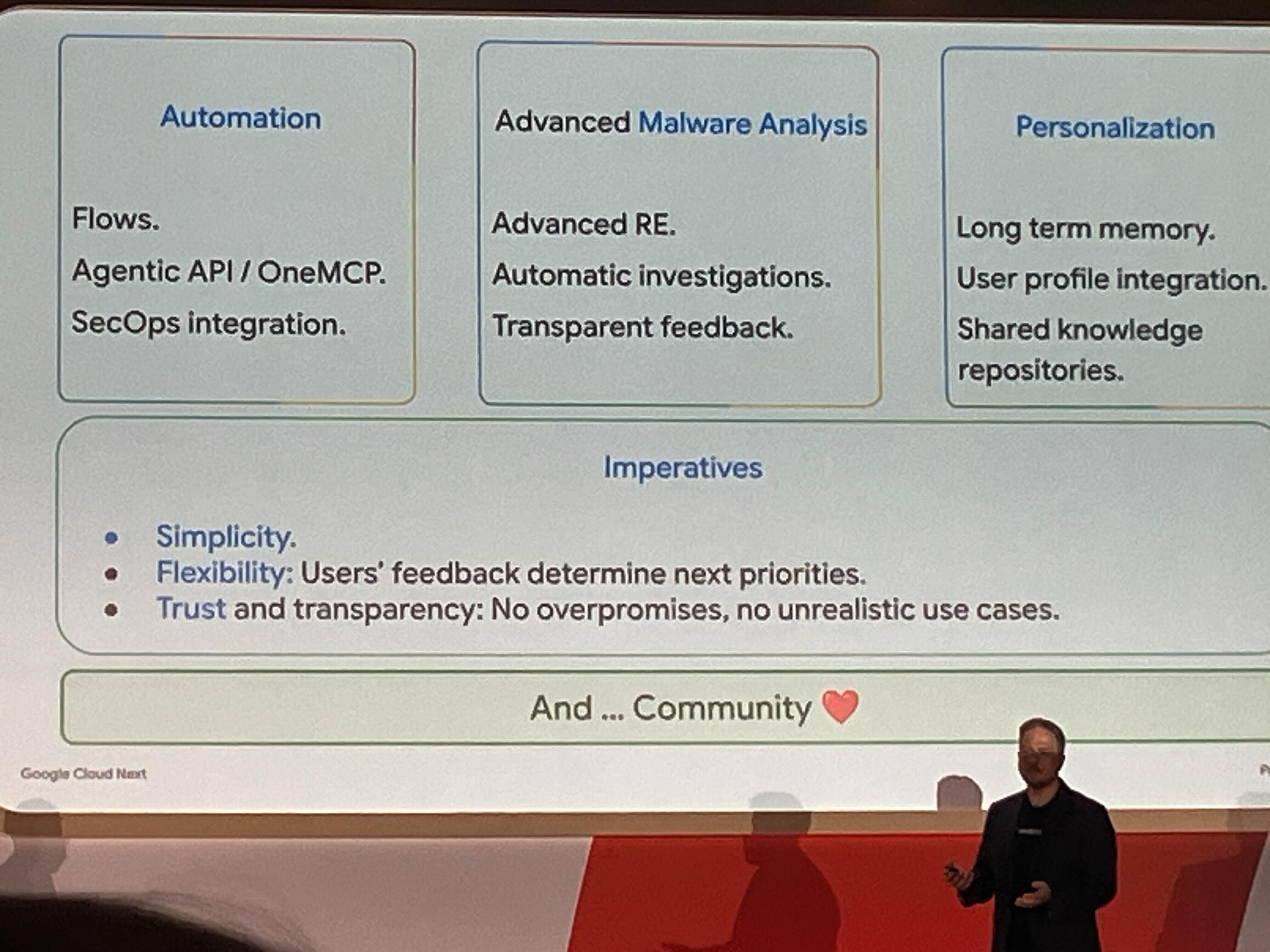

なぜ今、セキュリティ運用においてAIによる自動化が強く求められているのでしょうか。多言語でのインシデント対応や、膨大なアラートによる担当者の疲弊といった課題があるからです。しかし、だからといってAIエージェントにすべてを丸投げすることには、組織の根幹を揺るがす重大なリスクが伴います。

最大の危険は、「説明責任の欠如」と「コンプライアンス違反のリスク」です。重大なインシデントを見逃した際の言い訳として、私は時々、飛行機の自動操縦の例を挙げます。昨今の旅客機もほとんど自動運転といいます。ただ、常に自動運転が正しい判断をするとは限りません。「AIがそう判断したから理由はわかりません」と説明するのは、まるでパイロットが「自動操縦がそうしたから」と事故の原因を弁解するのと同じくらい、通用しない言い訳であるということです。

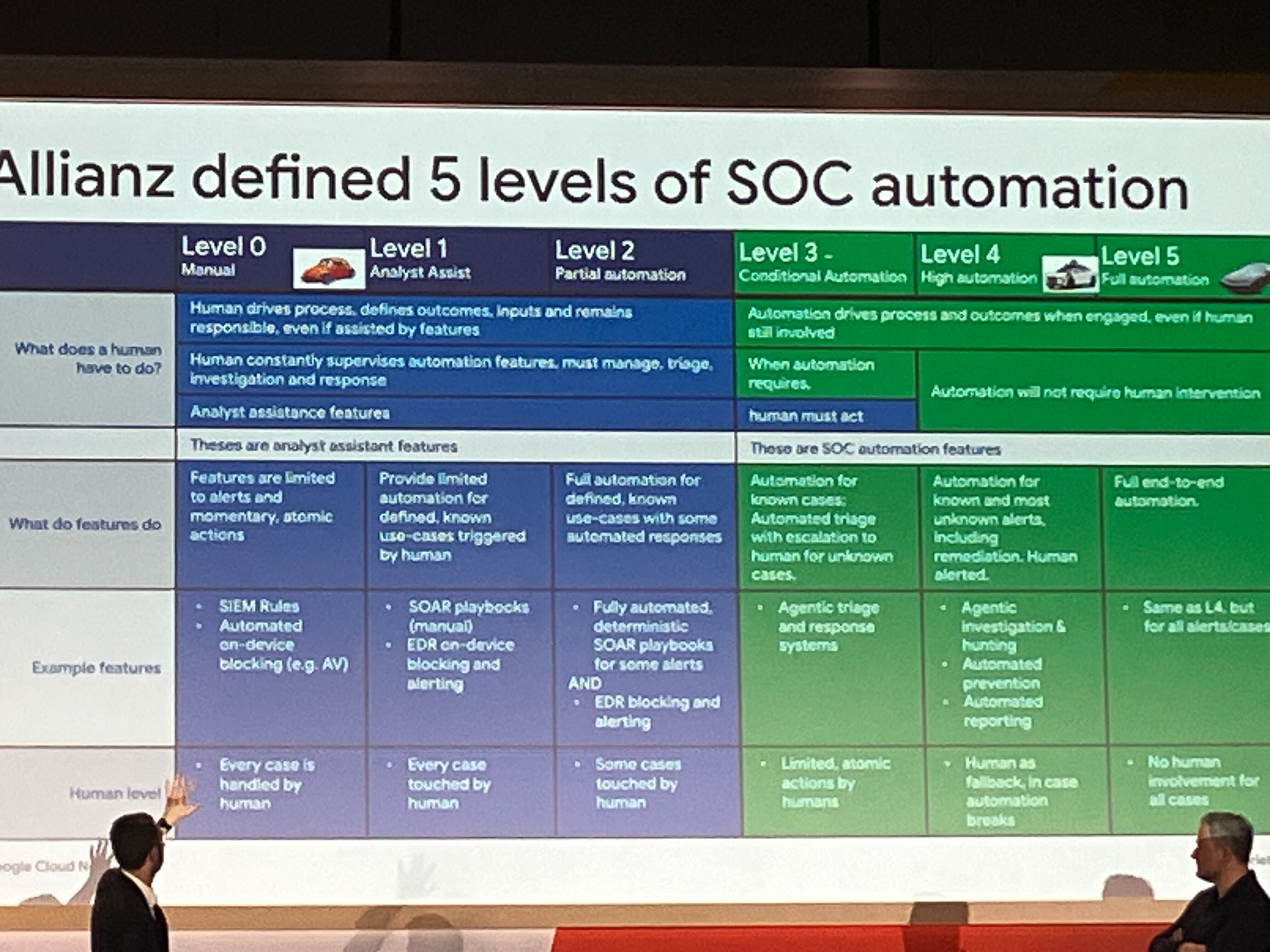

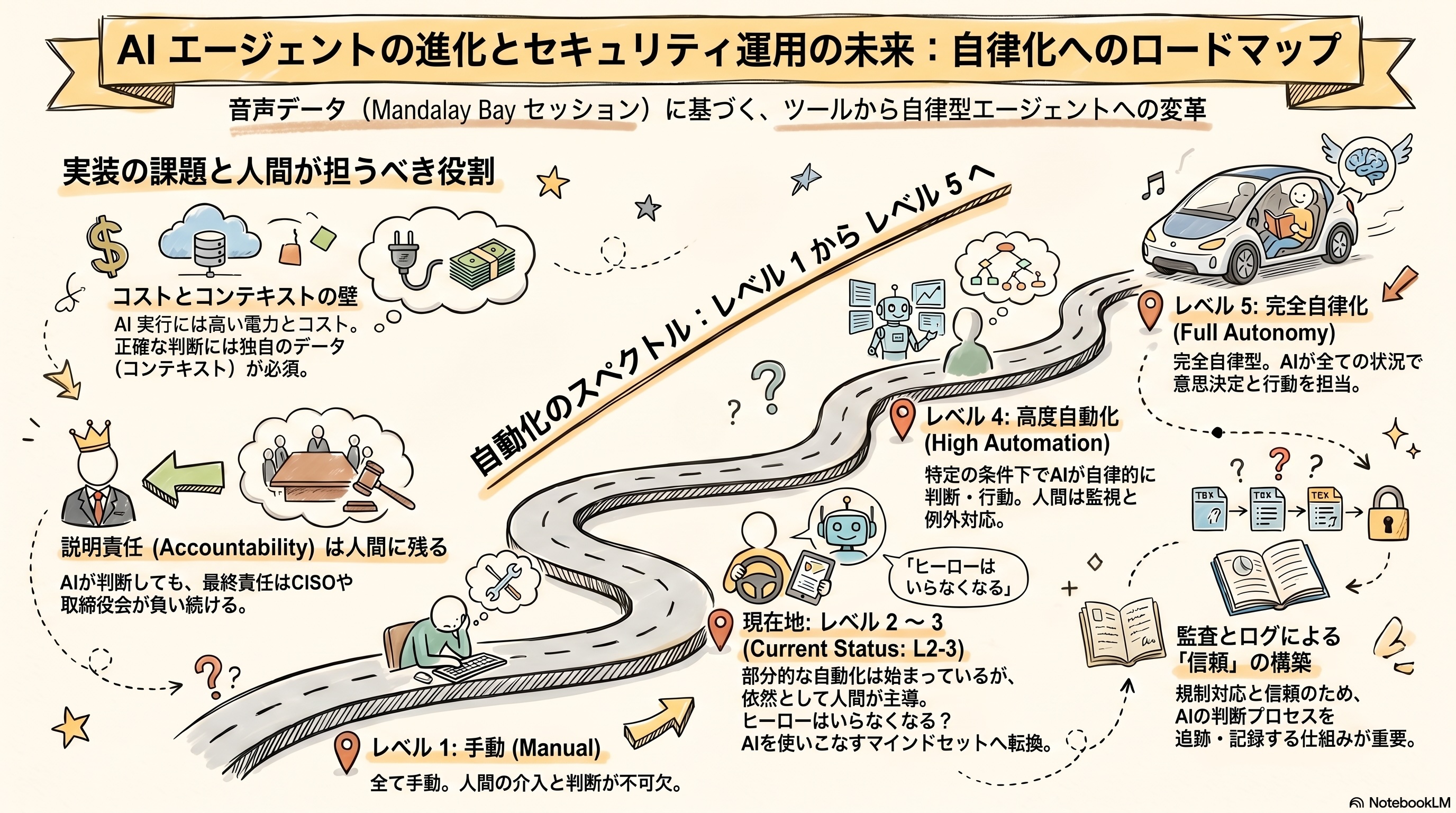

自動運転に学ぶ、段階的な自動化アプローチ

このようなリスクを回避するためにはどうすればよいのでしょうか。ここで重要になるのが、車の「自動運転」のレベル分けに例えられる段階的なアプローチです。

レベル1の完全手動から、レベル5の完全自動までの道のりにおいて、いきなりレベル5を目指すのは無謀です。現在、最前線で運用しているGoogleのチームであっても、レベル2とレベル3の間を推移しており、段階的に自動化を進めていると強調されています。AIを「副操縦士」から、自律的に動く「超優秀な新入社員」へと徐々にステップアップさせていく戦略が必要です。

実践:Google Threat Intelligence における HITL ワークフロー

それでは、実際にGoogle Threat Intelligenceの膨大なデータと、Vertex AI / Geminiを組み合わせて、どのようなインシデント対応を構築しているのか見ていきましょう。

AIに完全な自己完結を委ねるのではなく、重要な操作の際は必ず人間の承認を挟む Human In The Loop(HITL)のアプローチを採用します。非決定論的なLLMの上に、決定論的な人間のチェックポイントを重ねるようなイメージです。

1. 初期トリアージと多言語コンテキストの収集

グローバルなビジネス環境では、ローカル言語を含む複雑なインシデントが発生します。ここで、Geminiの72言語に対応する強力な処理能力を活用し、情報をアナリストが理解できる形に翻訳・要約させます。

2. アトミックな質問の生成

AIは収集したコンテキストをもとに、人間に対して「このファイルは悪意があるか?(Yes / No)」といった、極めてシンプルでアトミックな(これ以上分割できない)質問を作成し、提示します。AIから人間にオープンエンドな質問をして、人間の作業を増やしてはなりません。

3. 人間の判断と後続処理の実行

人間はAIがまとめた情報から「Yes」と判断を下します。それを受け取ったAIエージェントが、ネットワークからの隔離などの後続処理を再開します。

これは、超優秀な新入社員(AI Agent)が事前に資料をすべて読み込んで状況を整理し、「課長、ここだけ承認をお願いします」と決裁を仰ぐようなものです。

運用で見えたコストの壁と監査への対応

このような高度なAIシステムを運用する中で、いくつかの現実的な壁に直面したと述べられています。

1. コストの壁は想像以上に高い

最も痛感するのは、「AIの運用コスト」です。最新のモデルを使ってクールなシステムを構築しても、数万のアラートすべてに重い推論を走らせると、コンピュートリソースやトークン費用が膨大な額に跳ね上がります。従来の安価なログフィルタリングで弾けるものは弾き、本当に複雑なコンテキストの理解が必要な場面でのみAIを利用する、といった賢い使い分けが不可欠です。

2. 詳細なログ取得が監査の命綱になる

前述した通り、AIの判断のブラックボックス化は許されません。エージェントが意思決定を行う際のコンテキスト情報やプロンプトの内容を適切にロギングし、監査に耐えうる透明性を確保する仕組みが絶対に必要です。これにより、問題発生時の原因究明が可能になるだけでなく、法務・コンプライアンスチームに安心感を与えることができます。

まとめ

AI Agent がもたらすものは発展か破壊か?私は、前者と考えます。Google Threat Intelligence や Vertex AI を適切に活用することで、複雑な脅威への迅速な対応が可能になります。一方で、コストの最適化や、監査に耐えうる透明性の確保といった課題に立ち向かう必要があります。まずは、人間の承認を適切に挟む HITL ワークフローから導入することをお勧めします。

本ブログが安全な次世代セキュリティ運用構築に一役立てば幸いです。