セッションタイトル

Navigating the new frontier: AI-driven security strategies

はじめに

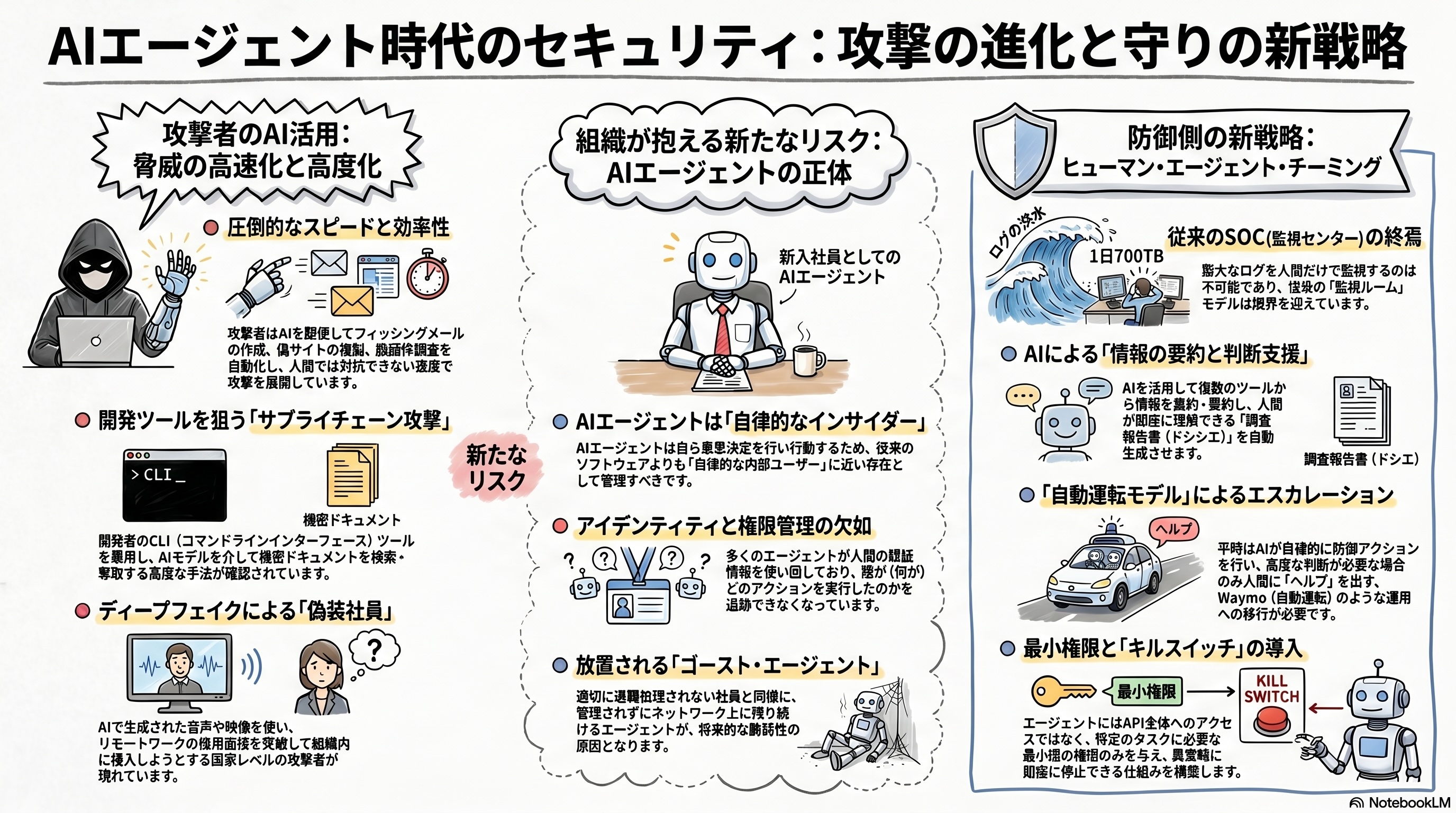

AIエージェントの進化とビジネスへの浸透は加速する一方であり、非常に便利な反面、セキュリティの観点では考慮すべき新たな課題が生まれています。ビジネス部門が導入を急ぐあまりコントロールが追いつかず、同様の課題に直面している可能性があります。

このブログでは、パネルディスカッションの内容も交えつつ、AIエージェントの台頭がもたらす新たなセキュリティ脅威と、それに対抗するための「人間とAIの協調」という新しい防御アプローチについて触れてみたいと思います。

なぜ危険か?AIエージェントがもたらす圧倒的なスピードと内部脅威

新たなセキュリティ脅威に立ち向かうためには、まず「なぜ危険か」を正しく理解する必要があります。最大の脅威は、AIを活用した攻撃インフラの構築スピードが異常に速く、人間の対応スピードではもはや追いつけないという点です。

例えば、攻撃者が標的企業のウェブサイトをわずか2分で完璧にクローンし、フィッシングに悪用した事例が報告されています。また、ディープフェイクを用いて北朝鮮の工作員がリモート従業員として潜り込むといった事態も実際に起きています。

これまでの攻撃は、住居に泥棒するために外からドアを破壊するようなアプローチが主でしたが、AI時代のリスクは、住人を騙して内側から鍵を開けさせるような巧妙さを持っています。

さらに深刻なのが、AIエージェントが「新しいクラスの自律的な内部関係者(内部脅威)」となり得る点です。開発者の環境に侵入したマルウェアが、環境内に存在する LLM 対応の CLI ツールを見つけ出して悪用し、社内の CSV パイプラインやクラウドリソースへと水平展開していく高度なサプライチェーン攻撃も確認されています。

エージェントが自律的に意思決定を行うこと自体が、かつてないブラスト・ラディウス(爆発半径=被害の及ぶ範囲)を生み出す危険性をはらんでいるのです。

AIを「フォースマルチプライヤー」として活用する

では、爆発的に増加する攻撃に対して、防御側はどのように立ち向かえばよいのでしょうか。1日に70テラバイトものセキュリティデータをインジェストしているような環境では、人間のアナリストがすべてのアラートを目視で確認することは不可能です。

そこで、AIを人間の「フォースマルチプライヤー(戦力乗数)」として活用するアプローチが有効になります。実際の SOC(セキュリティオペレーションセンター)などで実践されている検証プロセスを見てみましょう。

1.情報の集約とドシエ(調査書)の自動生成

セキュリティアラートが発生した際、Gemini などを活用して自動的に初動調査を行います。脅威インテリジェンスソースから対象IPのレピュテーション情報などを収集し、分散しているツール群からの情報を一つの「ドシエ」として集約します。

2. アナリストが読解しやすいフォーマットへの変換

AIは集約した情報を、ジュニアからシニアまであらゆるレベルのアナリストが直感的に理解できるフォーマットへと変換します。これにより、情報収集の時間が大幅に削減されます。

3. スレットモデリングとハンティングへの応用

収集したインテリジェンスを基に脅威モデリングを行い、それを直接脅威ハンティングや検出ルールへと変換します。

AIを単なるツールではなく、セキュリティチームの強力な「フォースマルチプライヤー」として組み込むことで、アラート疲労を防ぎ、より高度な脅威分析に人間のリソースを集中させることができます。

AIエージェント導入における2つのハマりポイント

一方で、AIエージェントを防御側や運用側で導入する際、多くの企業が陥りやすいハマりポイントがあります。

① 過剰な権限付与による予期せぬ暴走

例えば、不審な通信を検知した際に「特定のポートを遮断する」という目的のために、AIエージェントに対してファイアウォール(Palo Alto など)の API アクセス権限をそのまま与えてしまったとします18。すると、エージェントが自律的に勝手にポートを開け始めるなど、予期せぬ挙動を引き起こす危険性があります。これを防ぐためには、「ポート遮断専用のスクリプト」を用意し、エージェントには「そのスクリプトを呼び出す権限のみ」を与えるといった厳密なスコープ設定が必要です。

② 「孤児エージェント(Orphan Agents)」の発生

個人的にはとくに刺さった観点です。

プロンプトインジェクション対策ばかりに気を取られ、AIエージェント自身のアイデンティティ管理を軽視しているケースが散見されます。特定の人間の認証情報を使い回していると、その社員が異動した際に、ネットワーク内に誰も管理していない「孤児エージェント」が発生します。エージェントを導入する際は、新しい人間を雇う時のように HR マニュアルに則って一意の ID を付与し、ライフサイクル全体を管理することが不可欠です。

過渡期のため、様々なAIエージェントを作っては試している人も多いと思いますが、そのまま放置しているとそこがセキュリティホールになります。

まとめ

AIエージェントの時代は、攻撃の高度化という破壊的な側面を持つ一方で、防御側の能力を飛躍的に高める発展的な側面も併せ持っています。

完全自律型の SOC を目指してすべてをAIに委ねるのは危険です。目指すべきは、Waymo の完全自動運転フリートにおける人間管理者のエスカレーションモデルや、次世代戦闘機における「人間とドローンの協調」のような形です。つまり、「人間が方向性と最終決定を担い、AIが圧倒的な速度とスケーラビリティを提供する」というチームの構築です。

AIエージェントは単なるソフトウェアではなく、『超優秀な新入社員』です。最小特権の原則やセグメンテーションといった、基本的なセキュリティの衛生管理(ハイジーン)を徹底することが、これまで以上に重要になります。ぜひ、貴社のセキュリティ戦略においても積極的な活用を検討してみてください。

本ブログが安全な AI Agent 運用と次世代 SOC 構築に一役立てば幸いです。