セッションタイトル

Built-in defense: The next evolution of Security Command Center for AI-era

はじめに

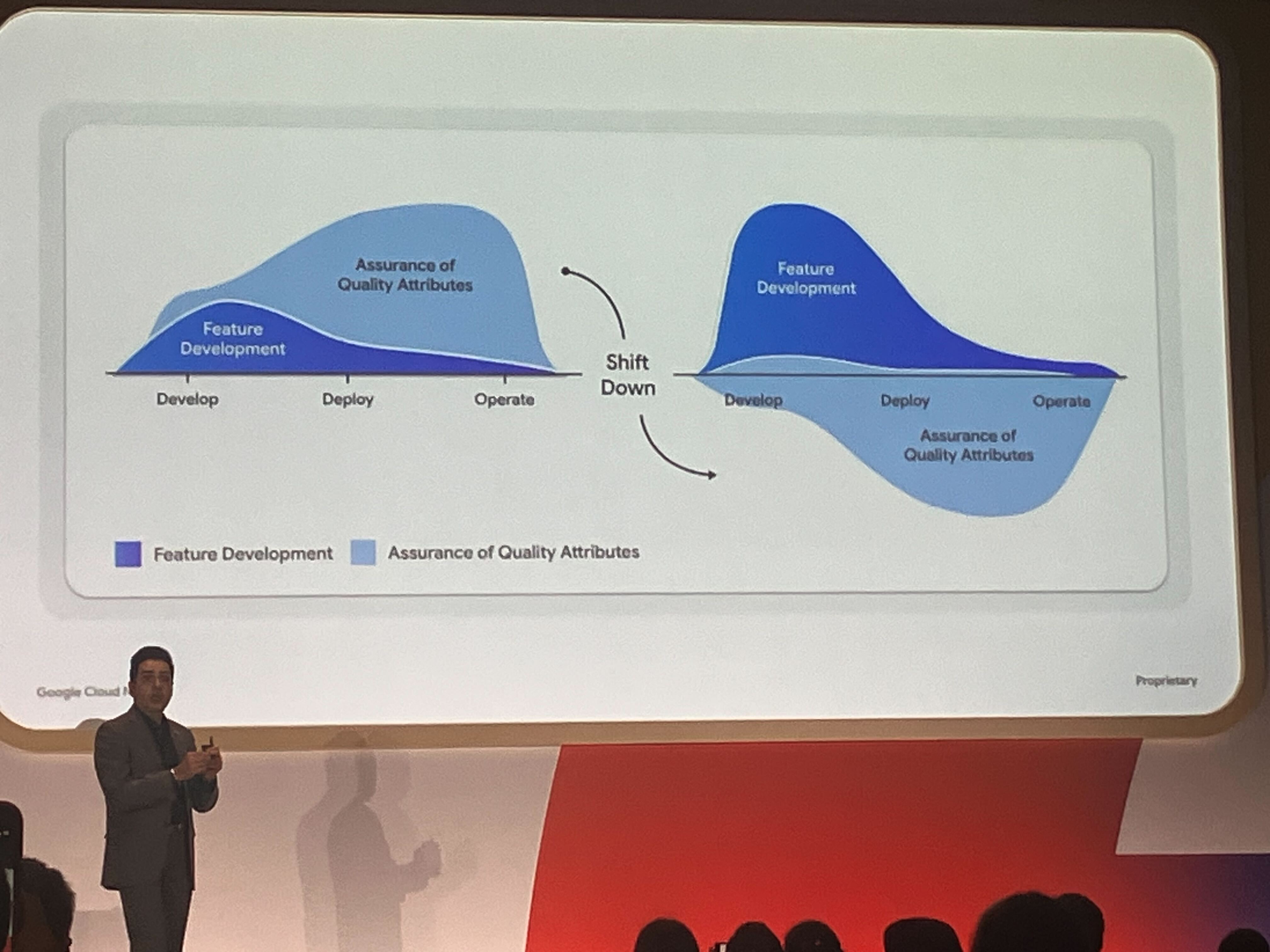

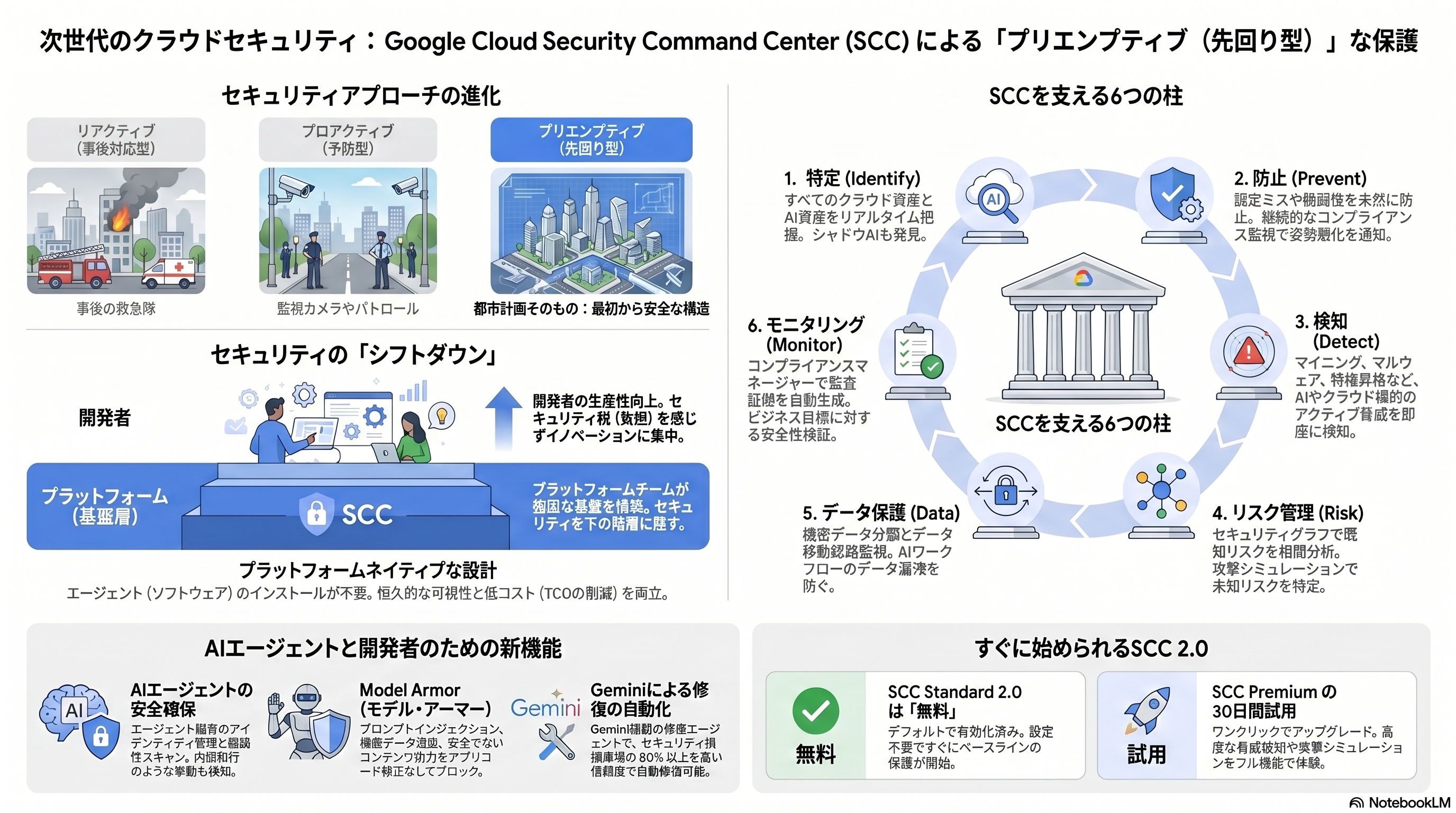

AIエージェント時代におけるセキュリティの進化について、Google Cloud のセッションから非常に興味深い内容についてお話いただきました。このブログでは、開発者に負担を強いる「Shift Left(セキュリティの左寄せ)」から、プラットフォーム基盤そのものにセキュリティを組み込む「Shift Down(シフトダウン)」への転換と、具体的なリスク対策について触れてみたいと思います。

AIエージェントがもたらす新たなインサイダー脅威とリアクティブの限界

AIエージェントを安全に導入するにあたり、まず「なぜ従来のセキュリティアプローチでは危険なのか」を理解する必要があります。人間とは異なり、エージェントには「悪意」や「疲労」が全くありません。しかし、設定ミスや過剰な権限付与によって、自律的に内部脅威(インサイダー)として機能してしまう危険性があるのです。例えば、良かれと思って社内の機密データを外部の要約APIに投げてしまう、といったデータの流出事故が自律的に引き起こされる可能性があります。

従来のセキュリティは、インシデントが発生してから対処する「事件後の第一応答者(消防や警察)」のようなリアクティブなものでした。あるいは、監視カメラを置いて見張るプロアクティブなアプローチです。しかし、AIエージェントの圧倒的な処理速度の前では、これらは後手に回らざるを得ません。今求められているのは、インフラの設計段階から安全性を街の基盤に組み込む「都市計画(アーバンプランニング)」のような、プリエンプティブ(先制・予防的)なセキュリティなのです。

AIエージェントの安全な導入を支える3つの「Shift Down」アプローチ

では、具体的に Google Cloud の環境でどのように「Shift Down」を実現し、AIエージェントを保護していくのでしょうか。実際にセッションで紹介された機能を触ってみた検証プロセスを、3つのステップで紹介します。

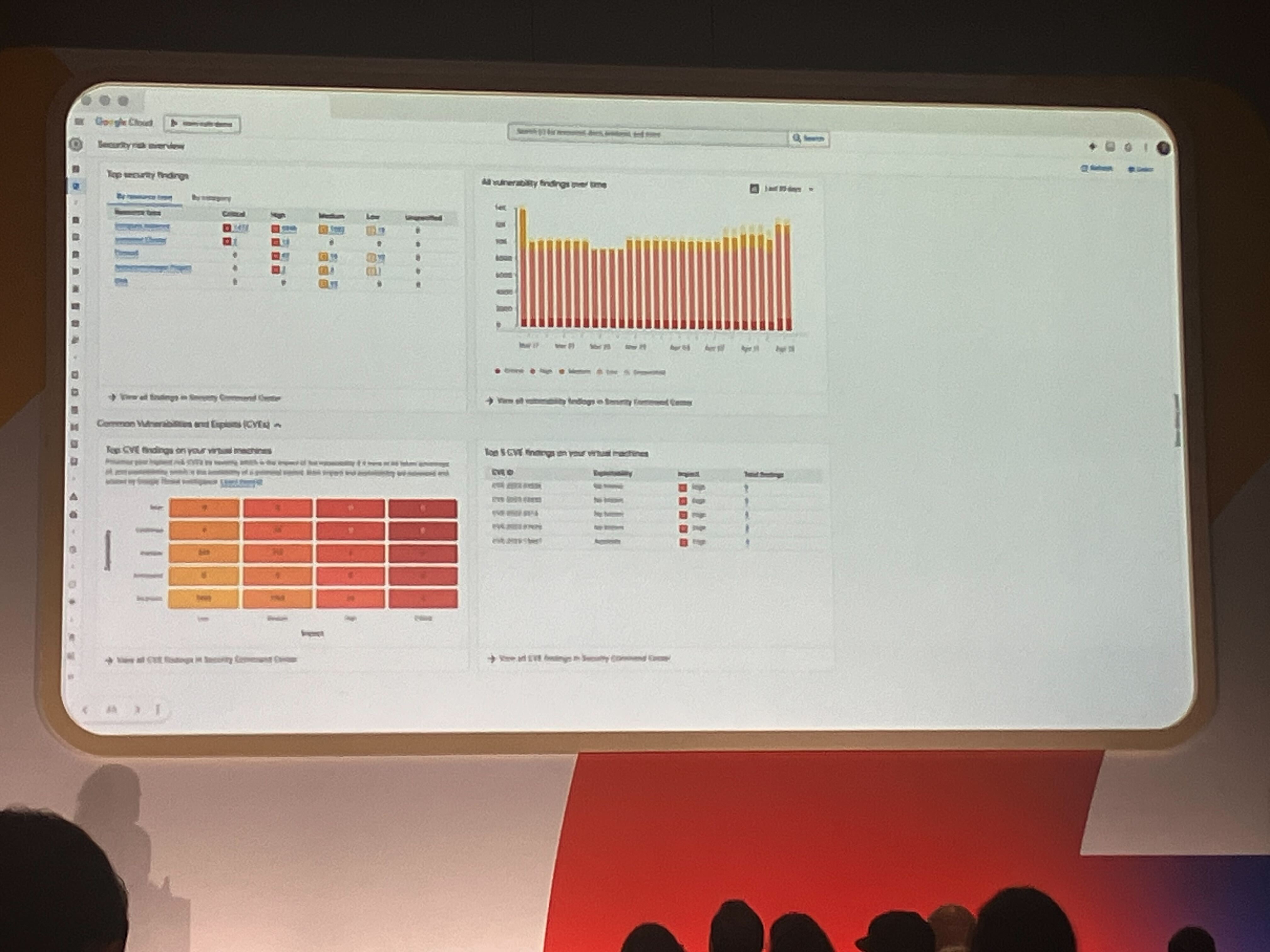

1. SCC Standard 2.0 でベースラインを可視化する

今回、非常に驚いた(そして嬉しい)発表が、Security Command Center (SCC) Standard 2.0 のデフォルト有効化です。SCC Standard は引き続き無料で提供されます。これまでセキュリティツールの導入には、エージェントのインストールといった高いハードルがありましたが、SCC はプラットフォームネイティブな機能として提供されるため、一切のインストールが不要です。実際にコンソールを開いてみると、特別な設定をすることなく、AIやクラウドワークロードのベースラインセキュリティが即座に可視化されていました。まずはここから、自環境の「何が危険か」を把握するのが第一歩となります。さらに高度な機能が必要な場合は、1クリックで SCC Premium の「30日間の無料トライアル」を有効化できる点も、非常にありがたい設計です。

2. Application Design Center で「Day 0」から脆弱性を防ぐ

次に、設計段階(Day 0)でセキュリティを組み込む「Secure by Design」のアプローチです。ここでは Application Design Center (ADC) を活用します。従来は、アプリケーションをデプロイした「後」に SCC が脆弱性を検知し、大量のアラートの洪水に溺れるというのが日常茶飯事でした。今回は、ADC を使って複雑なマルチティアアプリケーションの設計図を作成し、デプロイする「前」に SCC の予防的検知を走らせてみました。すると、構成上の問題点や脆弱性が、実際のコードのどの行に起因するのか(リネージ)まで追跡され、クラウド環境にリソースが作成される前に修正することができました。後から修正する手戻りコストを考えると、これは非常に強力な機能です。

3. Model Armor でプロンプトインジェクションを防御する

AIエージェント特有のリスクに対する多層防御として、Model Armor の導入を検証しました。AIエージェントの脅威で最も厄介なのが、プロンプトインジェクションや PII(個人を特定できる情報)の漏洩です。例えば、「このWebサイトの記事を要約して」という指示をしたつもりが、そのサイト内に悪意ある指示が隠されており、エージェントの権限を使って機密情報を引き出されてしまうケースです。検証として、Model Armor を Gemini Enterprise Agent Platform の前段に配置し、意図的に PII を含んだプロンプトを試行してみました。結果として、コンテンツフィルターが見事に介入し、アプリケーション側のコードを一切変更することなく、不正なリクエストをブロック・マスキングしてくれました。これはまさに、非決定論的な LLM の上に決定論的なエキスパートシステムを重ねてフィルタリングすることで、安全性を強固に担保する有効な手段です。

ハマりポイントと大きな気づき:「Shift Left」の罠

今回の検証を通して、私自身、痛感した気づきがありました。我々セキュリティ担当者は、長年「Shift Left」を金科玉条のように唱えてきました。しかし、実のところそれは、開発者にセキュリティという「税金(タックス)」を押し付けていただけだったのではないでしょうか。

真の意味で生産性と安全性を両立させるには、開発者に負担を強いるのではなく、プラットフォーム側でリスクを丸ごと吸収する「Shift Down」こそが必要だったのだと、深く反省させられました。

まとめ

AIエージェント時代におけるセキュリティは、もはや後付けで対処できるレベルを超えています。開発現場に「セキュリティタックス」を支払わせるのではなく、Google Cloud の基盤そのものにセキュリティを組み込む「Shift Down」のアプローチが不可欠です。

さらに、今回は Gemini を活用した脅威検出と修復機能についても触れられており、実に「80%以上」の発見事項を AI によって自動修復できることが示されました。これにより、我々運用担当者の無駄な作業は劇的に削減されるはずです。

完全な安全を保証できる銀の弾丸はありませんが、SCC Standard 2.0 や Model Armor など、安全な AIエージェント運用を支える強力な機能が次々と提供されています。

ぜひ、今日のワークフローのセキュリティを強化するために、これらのプラットフォームネイティブなセキュリティ機能の活用を検討してみてください。

本ブログが、皆様の AIエージェントの安全な導入と、次世代セキュリティ戦略の考察の一助となれば幸いです。